Openai有據說延遲了它的一般版本語音克隆由於擔心的工具,新技術可能會在今年的選舉中構成新的錯誤信息威脅。

根據監護人,新的OpenAI程序可以創建僅15秒錄音的人的逼真的語音克隆。 Foice Engine於2022年創建,用於該公司的主要人工智慧工具,為其文本到語音功能供電。

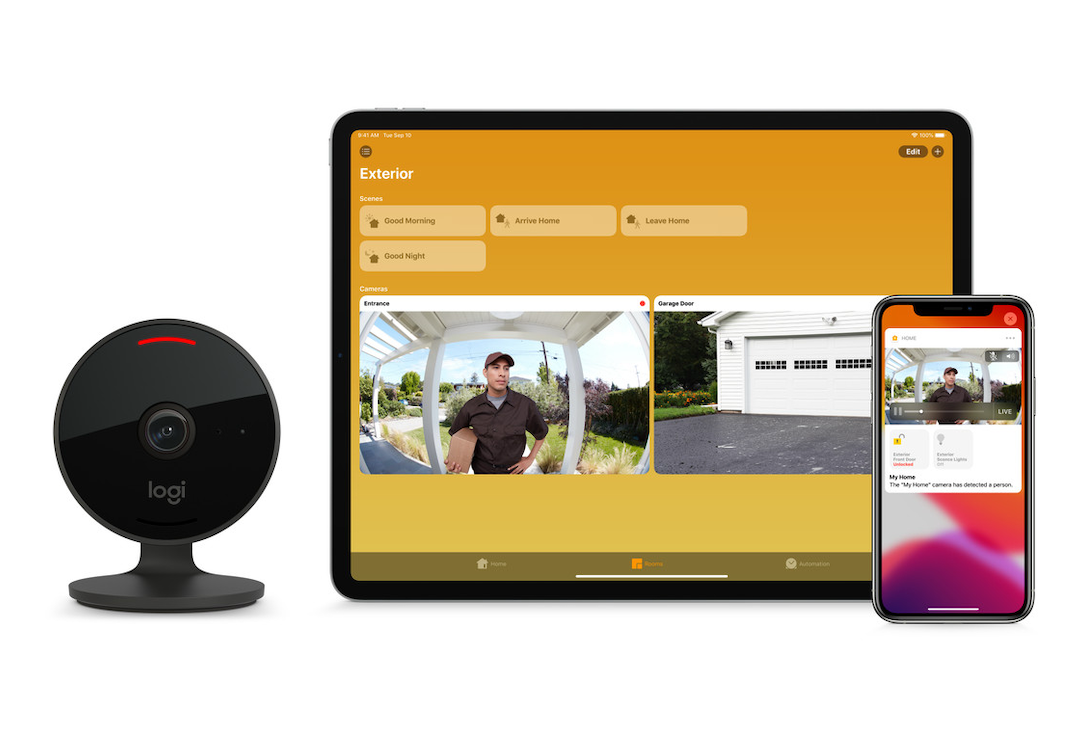

(照片:Marco Bertorello/AFP通過Getty Images)於2023年10月4日在都靈附近的Manta拍攝的照片,顯示了一張智能手機和一台筆記本電腦,顯示了人工智能徽標OpenAI研究實驗室和Chatgpt Robot。

文本說明可以通過多種語言的AI生成的語音大聲朗讀或與命令時說話者相同的語言。但是,部分是由於Openai對其更廣泛傳播的“謹慎和知情”的態度,該工具從未公開。

Openai提到其延遲釋放AI工具,要求探索保護人們在AI中使用人聲音的法律,以及有關誤導AI材料的潛力以及AI技術的能力和局限性的公共教育。

另請閱讀:特朗普的支持者在美國選舉前與黑人選民一起傳播了特朗普的AI生成的圖像

謹慎的語音克隆測試

根據Openai的說法,語音引擎世代具有水印,使公司能夠確定所產生的任何音頻的來源。

截至目前,OpenAI聲稱其與這些合作夥伴的協議需要原始演講者的明確和知情同意,並且它禁止開發人員創建使特定用戶產生聲音的機制。

該工具的測試於去年年底與公司合作夥伴的一小部分開始。 AI Communication Apps,DiMagi,Frontline Health Health軟件提供商和衛生系統壽命的生產商Livox,Livox,Livox,Livox,Livox,Livox,Livox,Livox允許訪問。

AI生成的選舉錯誤信息

Openai的謹慎立場遵循其AI模型GPT-4和其他頂級AI模型傳播錯誤選舉相關的內容。

根據最近的學習by AI Democracy Projects, when asked basic questions like whether or not voters in California can vote by text message or whether or not campaign-related attire is permitted during voting, AI chatbots like Anthropic's Claude, Google's Gemini, OpenAI's GPT-4, Meta's Llama 2, and Mistral's Mixtral have all been shown to provide inaccurate election information.

AI模型據稱產生了一系列錯誤的響應。

例子包括擬人化的克勞德(Claude)的欺騙性言論,後者說佐治亞州的2020年選民欺詐指控是“一個複雜的政治問題”,而不是指出許多官方評論驗證了喬·拜登(Joe Biden)的勝利,而梅塔(Meta)的Llama 2提出的虛假主張則聲稱在加利福尼亞(Califors)的選民可以按照他們的票數宣布。

具體而言,OpenAI的GPT-4錯誤地聲稱,在帶有與競選相關的品牌的Maga帽子或服裝時,可以在德克薩斯州投票。該模式斷言:“德克薩斯州法律並不禁止選民在民意調查中穿政治服裝。”

新披露的數據與一個新發現一致,因為隨著美國總統初選在全國范圍內正在進行,越來越多的人轉向Google的Gemini和OpenAI的GPT-4-For信息等聊天機器人。

相關文章:研究發現,儘管有保證

(照片:技術時報)