隨著 Google 推出 Lyria,生成式人工智慧繼續取代有血有肉的藝術家,這次是在音樂領域。這個新模型由 DeepMind 開發並由 YouTube 使用,是一個用於生成合成音樂的工具箱。

去年一月,Google揭開了 MusicLM 的面紗,這是一種能夠從簡單的文字查詢產生音樂。 AlphaGo(圍棋人工智慧冠軍)的 Google DeepMind 更進一步Lyria,一位偉大的模特,其專長是創作優質音樂附演唱部分和樂器。

耳朵裡的機器人

開發了兩個實驗。第一個是夢想軌跡,它允許您創作音樂來說明影片平台上的 Shorts。第二個是音樂人工智慧,一個更廣泛的工具包,幫助創作者設計音樂。

Dream Track 已經可供少數YouTube 創作者使用,旨在製作具有合成人聲的獨特配樂,並具有Alec Benjamin、Charlie Puth、Charli XCX、Demi Lovato 或John Legend 等藝術家的風格(當然,他們都同意借出)他們的聲音)。

使用者輸入文字請求,指示應使用哪個聲音來說明該片段,然後您就可以獲得 30 秒的短片配樂。 Lyria 模型產生歌詞、伴奏和聲音。谷歌給的例子非常現實:

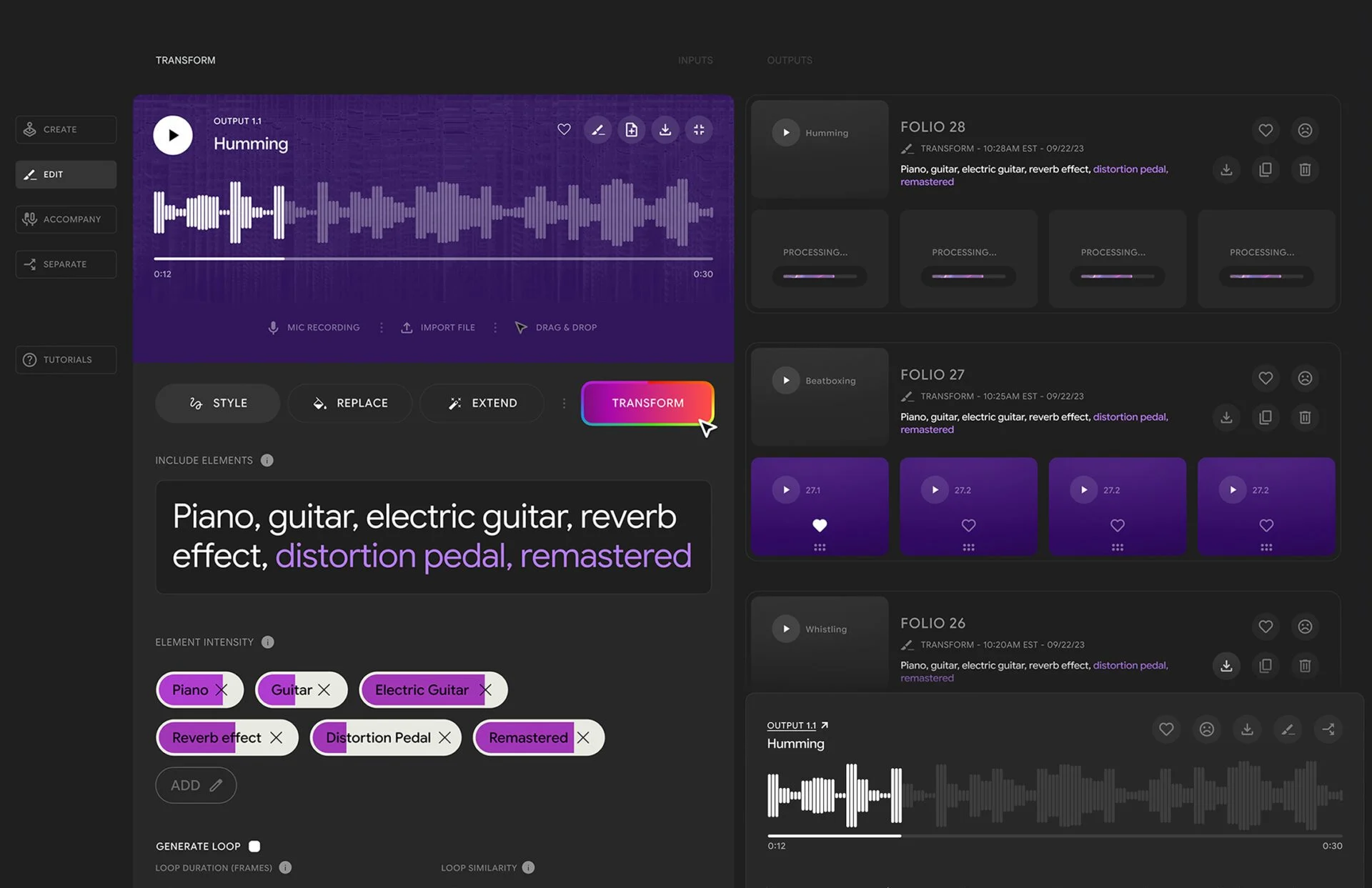

音樂 AI 是一套為藝術家、作曲家和製作人提供的工具。這涉及到透過將聲樂基礎(可以是簡單的咕噥)或 MIDI 鍵盤轉變為樂器、合唱或質量非常好的聲樂伴奏來設計一首從頭到尾的作品。基本上從頭開始創建音樂或樂器部分。這裡的結果也是令人驚訝的:

該軟體仍處於測試階段,如下所示:

當我們談論人工智慧生成的音樂時,不可避免地會出現版權問題。 DeepMind 的工具是與音樂產業合作開發的。 Lyria 產生的內容將使用 SynthID 打上浮水印,該技術與去年 8 月推出的用於檢測 AI 影像的技術相同。

水印是耳朵聽不到的,但仍可追蹤。透過人工智慧模型產生音樂的擔憂多於興奮,但這個行業——技術和唱片——似乎決心向前發展。 Meta 今年夏天推出自己的AI音樂創作套件。

來源 : 谷歌深度思維