หลังจากการไตร่ตรองและล่าช้ามานานกว่าหนึ่งปี Apple เพิ่งยุติโครงการที่ต้องการต่อสู้กับการเผยแพร่เนื้อหาลามกอนาจารเด็ก แต่กลับคุกคามเสรีภาพที่สำคัญ ขณะนี้ยักษ์ใหญ่แห่งอเมริกากำลังใช้เส้นทางอื่นซึ่งอยู่ต้นน้ำต่อไป

นรกถูกปูไว้ด้วยความตั้งใจดี และการต่อสู้กับอาชญากรรมก็เช่นกัน ในกรณีนี้คือ อาชญากรรมเกี่ยวกับเด็ก

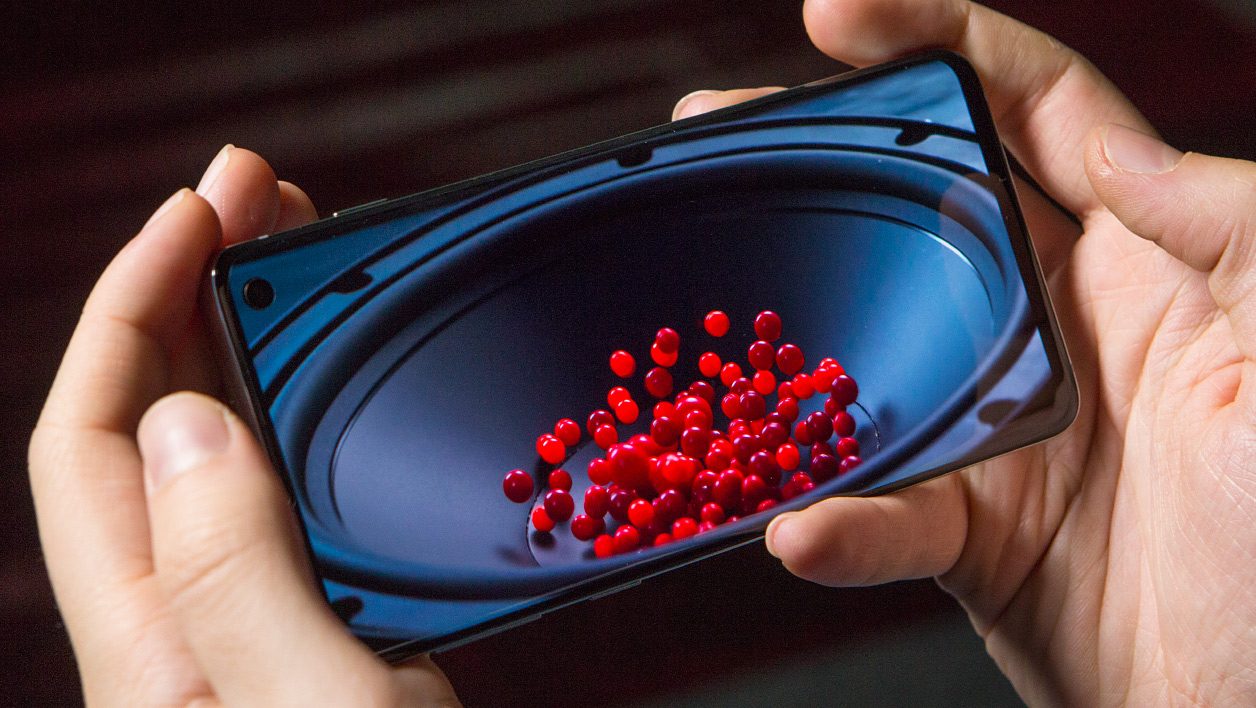

ในเดือนสิงหาคม 2564Apple ประกาศความตั้งใจที่จะติดตั้งระบบเฝ้าระวังเพื่อต่อต้านการเผยแพร่เนื้อหาลามกอนาจารเด็ก (CSAM เป็นภาษาอังกฤษ forสื่อการล่วงละเมิดทางเพศเด็ก- สำหรับสิ่งนี้ แม้จะบ่งชี้ว่าจะรักษาความเป็นส่วนตัวของผู้ใช้ แต่ก็มีจุดประสงค์เพื่อวิเคราะห์รูปภาพที่คุณถ่ายหรือได้รับ โดยใช้ตัวกรองที่ควบคุมโดยอัลกอริธึมปัญญาประดิษฐ์

หากแรงจูงใจนั้นน่ายกย่อง ความเสี่ยงในการใส่เครื่องมือเฝ้าระวังเข้าไปใน iPhone ของเราก็ดูจะมากเกินไป จนถึงจุดที่ผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์และสมาคมหลายแห่งที่ปกป้องเสรีภาพส่วนบุคคลส่งเสียงเตือน ในขณะนั้นมูลนิธิ Electronic Frontier Foundation เกรงว่า Apple จะสร้างขึ้นมา“โครงสร้างพื้นฐานที่ง่ายเกินกว่าจะเปลี่ยนเส้นทางให้กลายเป็นเครื่องมือในการสอดแนมหรือการเซ็นเซอร์ -เพียงหนึ่งเดือนต่อมา ในเดือนกันยายนยักษ์ใหญ่แห่ง Cupertino ประกาศอย่างเป็นทางการว่ากำลังหยุดการพัฒนาเครื่องมือของตนชั่วคราวเท“ใช้เวลามากขึ้นในช่วง 2-3 เดือนข้างหน้าเพื่อรวบรวมคำติชมและปรับปรุง”-

สิ้นสุดโครงการอันเป็นที่ถกเถียง

ตั้งแต่นั้นมา ในระหว่างขั้นตอนของการรวบรวมปฏิกิริยาและความคิดเห็น โครงการนี้ก็ยังคงรอบคอบ จนกระทั่งเมื่อวาน นอกจากการประกาศการดำเนินการที่จะเกิดขึ้นของการเข้ารหัสข้อมูลสำรองจากต้นทางถึงปลายทางใน iCloudที่จริงแล้ว Apple เพิ่งทำให้การละทิ้งโครงการนี้เรียบง่ายและบริสุทธิ์อย่างเป็นทางการ

ในการแถลงข่าวให้กับเพื่อนร่วมงานของเราที่แบบมีสายยักษ์ใหญ่แห่งอเมริกาอธิบายว่า:“เราได้ตัดสินใจที่จะไม่ทำงานกับเครื่องมือตรวจจับ CSAM สำหรับรูปภาพ iCloud ต่อไป เด็กสามารถได้รับความคุ้มครองโดยไม่ต้องมีบริษัทขุดข้อมูลส่วนบุคคล และเราจะยังคงทำงานร่วมกับรัฐบาล ผู้สนับสนุนเด็ก และบริษัทอื่นๆ เพื่อช่วยปกป้องเยาวชน รักษาความเป็นส่วนตัวของพวกเขา และทำให้อินเทอร์เน็ตเป็นสถานที่ที่ปลอดภัยยิ่งขึ้นสำหรับเด็กและเราทุกคน -

เส้นทางใหม่…สู่แหล่งที่มา

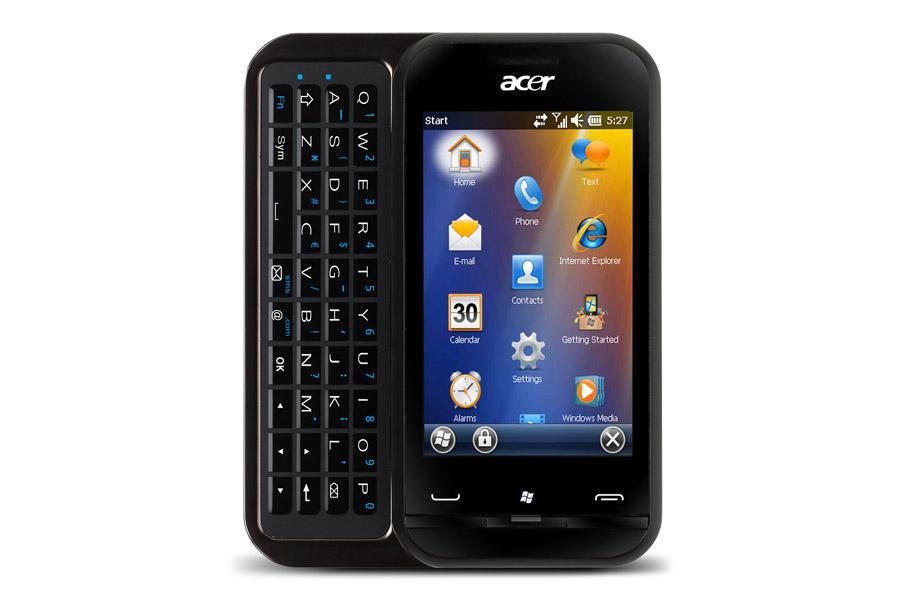

อย่างไรก็ตาม Apple ไม่ได้ละทิ้งการต่อสู้กับสื่อลามกเด็กและการล่วงละเมิดทางเพศ เขาจึงจะเน้นไปที่เครื่องมือรักษาความปลอดภัยการสื่อสาร- ฟังก์ชันที่เปิดตัวในเดือนธันวาคม 2021 ในสหรัฐอเมริกา และรวมอยู่ใน iOS 16 ในฝรั่งเศสและเยอรมนีตั้งแต่เดือนกันยายนปีที่แล้ว

เครื่องมือนี้ช่วยให้พ่อแม่หรือผู้ปกครองตามกฎหมายของเด็กสามารถเปิดใช้งานการป้องกันสมาร์ทโฟนของผู้เยาว์ที่บัญชี iCloud เชื่อมโยงกับครอบครัวของผู้ใช้ คุณสมบัตินี้ช่วยให้คุณควบคุมเนื้อหาที่ได้รับ ส่ง หรือดูจากการค้นหาของ Siri, Spotlight และ Safari และแน่นอนในแอพข้อความ ดังนั้น Apple จึงไม่ได้วางแผนที่จะดำเนินการย้อนหลังอีกต่อไป แต่เพื่อป้องกันการผลิตเนื้อหาเมื่อสามารถทำได้ เมื่อผู้ใหญ่ที่เป็นอันตรายสนับสนุนให้เด็กส่งรูปถ่ายของตัวเอง และเพื่อจำกัดการเปิดเผยให้มากที่สุด

แอปเปิลก็ได้รับความไว้วางใจแบบมีสายยังคงดำเนินการปรับใช้ฟังก์ชันความปลอดภัยการสื่อสารในประเทศอื่นๆ ต่อไป วิศวกรของยักษ์ใหญ่ชาวอเมริกันรายนี้กำลังทำงานเพื่อเพิ่มฟังก์ชันใหม่ๆ ให้กับเครื่องมือนี้ ดังนั้น โซลูชันสำหรับการตรวจจับภาพเปลือยในวิดีโอที่ส่งโดย Messages ควรได้รับการบูรณาการในเร็วๆ นี้ แต่ Apple มองไกลกว่านี้และต้องการให้นักพัฒนาบุคคลที่สามสามารถรวมเครื่องมือเข้ากับแอพพลิเคชั่นของพวกเขาได้ ดังนั้นเด็กๆ จะได้รับการแจ้งเตือนถึงความเสี่ยงที่ได้รับและได้รับการคุ้มครองในวงกว้างมากขึ้น โซลูชันที่เคารพความเป็นส่วนตัวและจะป้องกันไม่ให้เยาวชนถูกล่วงละเมิดโดยผู้ล่าทางเพศ เจตนาดีไม่มีนรก...

🔴 เพื่อไม่พลาดข่าวสาร 01net ติดตามเราได้ที่Google ข่าวสารetวอทส์แอพพ์-

แหล่งที่มา : แบบมีสาย