ระบบอัตโนมัติที่สามารถระบุเป้าหมายของมนุษย์และการยิงยังคงดูเหมือนนิยายวิทยาศาสตร์ อย่างไรก็ตาม สมาคมหลายแห่งกำลังรณรงค์ให้มีการสั่งห้ามในวันนี้

ในกวิดีโอดังกล่าวแพร่ระบาดในช่วงปลายปี 2560เราเห็นนักเรียนที่มีส่วนร่วมทางการเมืองถูกระบุตัวและยิงโดยฝูงโดรนขนาดเล็กที่เป็นอิสระ เห็นได้ชัดว่าเป็นฉากสมมติที่มีความสมจริงที่น่าสะพรึงกลัว

ผลิตโดยสมาคมต่างๆ โดยมีวัตถุประสงค์เพื่อแจ้งเตือนประชาชนทั่วไปถึงอันตรายที่จะเกิดขึ้นจากหุ่นยนต์นักฆ่า

ในทางเทคนิคแล้ว อาวุธประเภทนี้เรียกว่า “SALA” (ระบบอาวุธอัตโนมัติร้ายแรง) หรือระบบที่สามารถเลือกเป้าหมายของมนุษย์และการยิงได้ด้วยตัวเอง แนวโน้มที่ทำให้เกิดความกลัวในความคิดเห็นของสาธารณชนในปัจจุบัน: ชาวฝรั่งเศส 59% กล่าวว่าพวกเขาต่อต้านหุ่นยนต์นักฆ่า ตามการสำรวจที่ได้รับมอบหมายจาก Ipsos โดยแนวร่วมขององค์กรพัฒนาเอกชนรณรงค์หยุดหุ่นยนต์นักฆ่า และเปิดเผยต่อสาธารณชนเมื่อต้นปี

การอภิปรายอย่างกระตือรือร้น

บุคคลเช่น Elon Musk, Demis Hassibis (จาก DeepMind), Noam Chomsky, Bill Gates, Steve Wozniak, Yann LeCun และ Stephen Hawking ผู้ล่วงลับ ได้เรียกร้องให้มีการแบนคำร้อง ตำแหน่งที่มีร่วมกันใน 28 รัฐ เช่น ออสเตรีย บราซิล และชิลี และรุ่นใหญ่ในอ้อมแขนเช่นทาเลสกำลังเริ่มให้คำมั่นที่จะไม่สร้างหุ่นยนต์นักฆ่าด้วยซ้ำ

แต่ผู้เชี่ยวชาญด้านความปลอดภัยหลายคนรู้สึกรำคาญกับความหลงใหลที่การถกเถียงนี้กระตุ้น ซึ่งกระตุ้นให้เกิดจินตนาการทั้งหมดตามที่พวกเขากล่าว“ฉันอยากจะบอกว่าจริงๆ แล้วทุกคนต่อต้านหุ่นยนต์นักฆ่า เพราะเป้าหมายหลักของระบบอัตโนมัติไม่ใช่การฆ่ามนุษย์”Thierry Berthier นักวิจัยด้านการป้องกันทางไซเบอร์และความปลอดภัยทางไซเบอร์จากมหาวิทยาลัย Limoges กล่าว“คำถามคือการรู้ว่าเราต้องการไปไกลแค่ไหนในกระบวนการสร้างอาวุธอัตโนมัติซึ่งกำลังดำเนินการอยู่ พรุ่งนี้หุ่นยนต์ที่เฝ้าติดตามชายแดนเกาหลีเหนือด้วยปืนกลจะยิงเองหรือไม่? เรืออัตโนมัติที่ดำเนินการข่าวกรองจะไปไกลถึงขนาดตัดสินใจตอร์ปิโดศัตรูหรือไม่? -เขาถามตัวเอง

เห็นได้ชัดว่ากระบวนการของระบบอัตโนมัติของทุกกองทัพกำลังดำเนินอยู่ เรากำลังก้าวไปสู่ระบบหลายภารกิจและระบบมัลติฟังก์ชั่น ซึ่งเราสามารถเพิ่มความสามารถในการตัดสินใจสังหารได้

ผู้ก่อการร้ายสามารถสร้างหุ่นยนต์นักฆ่าได้แล้ว

แล้วความเป็นจริงทางเทคโนโลยีของศาลาล่ะ? มีระบบตอบสนองอัตโนมัติอยู่แล้วเพื่อจัดการกับสิ่งที่เรียกว่าการโจมตีแบบอิ่มตัว นี่เป็นกรณีของโดมเหล็กของอิสราเอล ซึ่งสามารถกระตุ้นการยิงขีปนาวุธเมื่อเผชิญกับกระสุนและจรวด แต่การตัดสินใจเบื้องต้นในการต่อต้านพวกมันยังคงกระทำโดยผู้ปฏิบัติงานที่เป็นมนุษย์ ปัจจุบันไม่มีหุ่นยนต์นักฆ่าอย่างเป็นทางการใช้งานในโลกนี้

- แต่มันคือความจริงทางเทคโนโลยี”บอกเราว่า โทนี่ ฟอร์ติน ผู้จัดการฝ่ายวิจัยของหอดูดาวอาวุธยุทโธปกรณ์- ในระดับฮาร์ดแวร์ คุณสามารถสร้างหุ่นยนต์นักฆ่าด้วยตัวเองได้แล้ว ส่วนประกอบเหล่านี้มีจำหน่ายอย่างเสรีในเชิงพาณิชย์ ทำให้เกิดความกังวลว่าผู้ก่อการร้ายอาจยึดชิ้นส่วนเหล่านั้นได้เขาเตือน การพยายามโจมตี Nicolas Maduro เมื่อฤดูร้อนปีที่แล้วในเวเนซุเอลาพิสูจน์ให้เห็นว่าเป็นไปได้ที่จะโหลดโดรนพลเรือน DJI ธรรมดาด้วยวัตถุระเบิด

อาวุธอัตโนมัติสำหรับปี 2030

นอกเหนือจาก DIY แล้ว บริษัทอาวุธที่จริงจังมากก็เริ่มทำงานกับระบบที่ซับซ้อนมากขึ้น ซึ่งสามารถปฏิบัติการได้ด้วยตนเองโดยสมบูรณ์ โดยเฉพาะอย่างยิ่งความก้าวหน้าในปัญญาประดิษฐ์

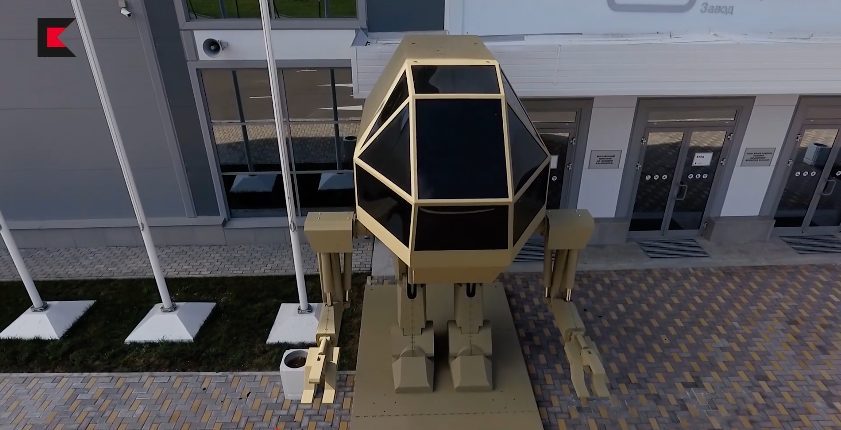

นี่เป็นกรณีของบริษัท General Robotics ของอิสราเอล ซึ่งจำหน่ายหุ่นยนต์ยุทธวิธี Dogo ซึ่งมี Glock 29 ขนาด 9 มม. อยู่ด้านบน มันให้ความเป็นไปได้ในการควบคุมการถ่ายภาพ... หรือปล่อยให้มันเกิดขึ้น ให้เราอ้างอิงถึง Kalashnikov ซึ่งอ้างว่าต้องการพัฒนาผลิตภัณฑ์ประเภทใหม่ที่มี AI ซึ่งสามารถตัดสินใจฆ่าได้ด้วยตัวเอง ไม่ว่าในกรณีใด นี่คือสิ่งที่โฆษกคนหนึ่งบอกกับสำนักข่าว Tass ของรัสเซียในปี 2560

ที่สหรัฐอเมริกาอิสราเอล จีน และรัสเซียเป็นประเทศที่ก้าวหน้าที่สุดในเทคโนโลยีเกิดใหม่เหล่านี้... และเป็นหนึ่งในประเทศที่ต่อต้านการห้ามใช้หุ่นยนต์นักฆ่า มีแนวโน้มว่าพวกเขาจะสามารถปรับใช้บางส่วนได้ภายในปี 2573 ตามที่ Tony Fortin กล่าว แต่ก่อนหน้านั้นพวกเขาจะต้องเอาชนะข้อจำกัดทางเทคโนโลยีสองประการให้ได้“ด้วยมุมมองในการใช้อาวุธอัตโนมัติมาเป็นเวลานาน มีปัญหาเรื่องเอกราชซึ่งยังไม่ได้รับการแก้ไข แต่ยังรวมถึงความสามารถของปัญญาประดิษฐ์ในการปรับให้เข้ากับสภาพแวดล้อมและการสุ่มในการตัดสินใจ”เขาสังเกต

การห้ามเป็นไปได้หรือไม่?

SALA ก่อให้เกิดปัญหาด้านจริยธรรมและกฎหมายมากมาย โดยการใช้ขัดต่อหลักการด้านสิทธิมนุษยชนและสนธิสัญญาระหว่างประเทศ ซึ่งมนุษย์ยังคงเป็นประเด็นหลัก เครื่องจักรไม่ได้เต็มไปด้วยความเห็นอกเห็นใจ และไม่รู้ราคาของชีวิต ในกรณีนี้จะสมเหตุสมผลหรือไม่ที่จะให้เธอตัดสินใจฆ่า? และใครจะเป็นผู้รับผิดชอบต่อการกระทำของพวกเขา? ระบบเหล่านี้ยังทำให้เกิดคำถามเพื่อความปลอดภัยอีกด้วย การโจมตีด้วยคอมพิวเตอร์มุ่งเป้าไปที่การแย่งชิงและควบคุมหุ่นยนต์นักฆ่าไม่ใช่สิ่งที่ต้องกลัวใช่ไหม

สำหรับ Aymeric Elluin หัวหน้าฝ่ายสนับสนุนอาวุธและความยุติธรรมระหว่างประเทศ แอมเนสตี้ อินเตอร์เนชั่นแนล ทางออกเดียวที่จะป้องกันไม่ให้สายเกินไปหนึ่งวันคือการแบนอุปกรณ์เหล่านี้ในวันนี้ และน่าเสียดายหากความพยายามทั้งหมดในการเจรจาที่ดำเนินการที่สหประชาชาติหรือภายในกรอบของอนุสัญญาว่าด้วยอาวุธทั่วไปบางอย่างในเจนีวาล้มเหลว -ไม่ใช่ทุกประเทศที่ได้ลงนามต่อต้านทุ่นระเบิดต่อต้านบุคคล แต่การห้ามของพวกเขาก่อให้เกิดแรงกดดันและตีตราประเทศที่เป็นอิสระจากพวกเขา ส่งผลให้การใช้งานของพวกเขาลดลง”-

“การที่ยังไม่มีหุ่นยนต์นักฆ่าไม่ได้หมายความว่าพวกมันไม่ควรถูกแบน”เบเนดิกต์ เจนเนรอด ผู้อำนวยการสำนักงาน Human Rights Watch ในฝรั่งเศส กล่าวเสริม “โอ้ประสบความสำเร็จในการห้ามใช้อาวุธเลเซอร์ที่ทำให้มองไม่เห็นก่อนที่จะออกสู่ตลาด เป็นต้น”-

ฝรั่งเศสระหว่างไฟสองครั้ง สองแรงบันดาลใจ

ตำแหน่งของฝรั่งเศสมีความเหมาะสมยิ่ง ในด้านหนึ่ง เธอไม่พลาดโอกาสที่จะเตือนเราว่ามนุษย์ยังคงอยู่ในลูปคำสั่ง

“หลักคำสอนของฝรั่งเศสยืนยันหลักการสองประการ ใช้ได้กับทุกระบบที่ให้บริการหรืออยู่ระหว่างการพัฒนา: คำสั่งมีหน้าที่รับผิดชอบในการใช้ระบบอาวุธเสมอ และเครื่องจักรยังคงอยู่ภายใต้การควบคุมของมนุษย์: มันไม่สามารถตัดสินใจได้เพียงลำพัง”Patrick Bezombes รองผู้อำนวยการศูนย์ร่วมด้านแนวคิด หลักคำสอน และการทดลอง อธิบาย แต่ประเทศเราก็ไม่ได้ไปไกลถึงจุดยืนในการห้ามศาลาเช่นกัน หากคำถามไม่ได้รับการแก้ไขอาจเป็นเพราะฝรั่งเศสกังวลเกี่ยวกับความทะเยอทะยานในด้านนี้ของประเทศที่กล่าวไปแล้ว ได้แก่ อิสราเอล จีน รัสเซีย และสหรัฐอเมริกา ดังนั้นจึงมีทางเลือกทางภูมิยุทธศาสตร์ที่มีความเสี่ยงต่อการแยกตัวและความเปราะบาง

“ประเทศที่เลือกที่จะสั่งห้ามระบบอาวุธอัตโนมัติเต็มรูปแบบเหล่านี้ หากเคยมีอยู่ ก็จะตกลงที่จะปลดอาวุธตัวเอง ส่วนฝรั่งเศสเราจะพัฒนาการใช้ AI ในระบบของเราอย่างไม่ต้องสงสัย เราจะทำเช่นนั้น เช่นเดียวกับเทคโนโลยีทางทหารทั้งหมด ด้วยความรับผิดชอบและสอดคล้องกับพันธกรณีระหว่างประเทศและกฎหมายมนุษยธรรมของเรา”ระบุเพิ่มเติมว่า Patrick Bezombes

อย่างไรก็ตาม Human Rights Watch ไม่สิ้นหวังที่จะเห็นประเทศของเราเปลี่ยนจุดยืน“เห็นได้ชัดว่าไม่ใช่คำถามที่ฝรั่งเศสสั่งห้ามหุ่นยนต์นักฆ่าเพียงลำพัง แต่อาจเป็นผู้นำแนวร่วมขนาดใหญ่ของรัฐและก่อให้เกิดการเคลื่อนไหวในระดับนานาชาติ”เธอแนะนำ ไม่นานหลังการเลือกตั้ง เอ็มมานูเอล มาครงได้พูดถึงเรื่องนี้ในนิตยสารอเมริกันแบบมีสาย-“ฉันต่อต้านเรื่องนั้น”เขาประกาศเกี่ยวกับหุ่นยนต์นักฆ่า โดยเชื่อว่ามนุษย์จะต้องรับผิดชอบต่อเครื่องจักรและตัดสินใจยิงเสมอ ตอนนี้มันขึ้นอยู่กับเขาซึ่งเป็นหัวหน้ากองทัพที่จะตัดสินใจ

🔴 เพื่อไม่พลาดข่าวสาร 01net ติดตามเราได้ที่Google ข่าวสารetวอทส์แอพพ์-