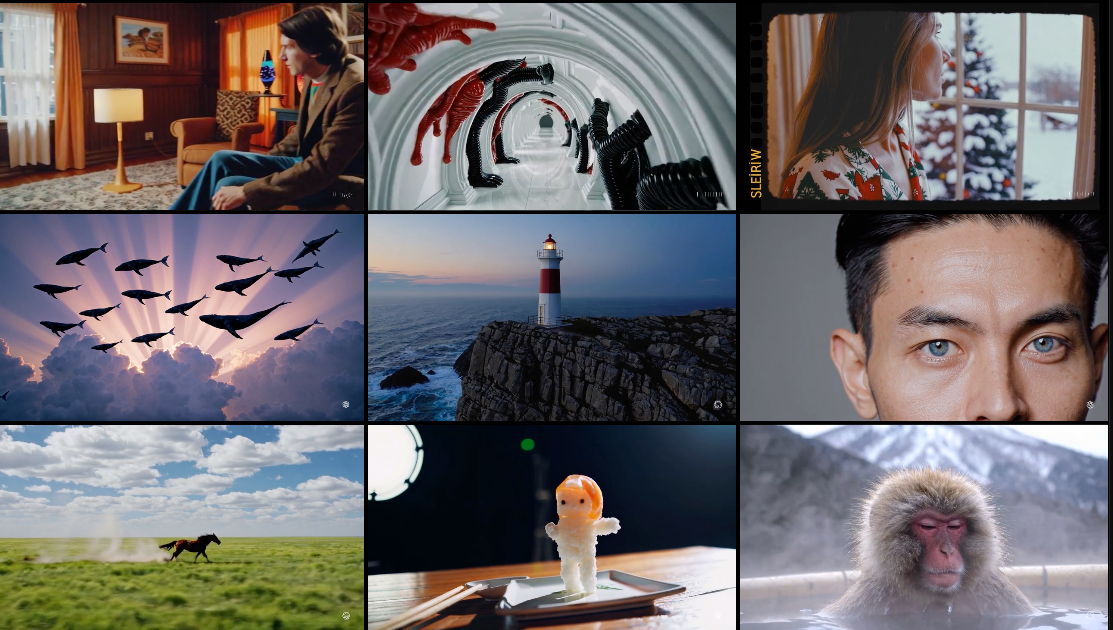

Google推出了一個尖端的文本對視頻人工智能(AI)發電機,稱為“Lumiere“這將徹底改變視頻中現實和多樣化的運動的綜合。

該項目由Google Research開發,引入了開創性的時空U-NET體系結構,旨在在單個模型通行證中生成視頻的完整時間持續時間。

“我們介紹了Lumiere - 一種旨在構成描繪現實,多樣和連貫運動的視頻的文本對視頻擴散模型 - 視頻綜合中的關鍵挑戰。為此,我們介紹了一個時空U-net體系結構,可以立即通過模型中的單身通行證,“在他們的論文中寫。

Google揭露了Lumiere

與創建遙遠的關鍵幀之後的現有視頻模型不同,Lumiere採用了一種獨特的方法,從而使全球時間一致性更具實現。

該體系結構結合了空間和時間向上和向上採樣,並結合了預先訓練的文本對圖像擴散模型。這使Lumiere可以通過在多個時空尺度上處理完整的低分辨率視頻直接產生全幀速率。

Google Research提出的文本到視頻生成框架代表了視頻綜合的重大飛躍。通過利用預先訓練的文本對圖像擴散模型並解決現有方法中的固有局限性,Lumiere展示了最新的文本到視頻生成結果。

創新的時空U-NET體系結構可以生成全幀速率視頻剪輯,其應用程序從圖像到視頻和視頻介入到風格化的內容生成。

T2i模型

該研究承認局限性,指出Lumiere並非旨在生成具有多個鏡頭或涉及過渡的場景的視頻。根據Google團隊的說法,這方面仍然是未來研究的挑戰。

此外,該模型基於在像素空間中運行的文本對圖像(T2I)模型建立,因此需要一個空間超分辨率模塊,用於高分辨率圖像生產。

儘管有這些局限性,Lumiere的設計原理仍然對潛在的視頻擴散模型有望,從而引發了潛在的途徑,以進一步探索文本到視頻模型開發。

Lumiere的主要目的是使新手用戶能夠創造性地創建視覺內容。但是,研究人員承認濫用的潛力,強調開發工具以發現偏見和防止惡意用例的重要性。

確保對該技術的安全合理使用是至關重要的,強調了Google對負責人AI開發的承諾。總而言之,Google的Lumiere代表了文本到視頻AI代的突破,為視頻中的現實和連貫的運動提供了一種新穎的方法。

該項目中展示的創新體系結構和設計原則為視頻合成技術的進步奠定了基礎,重點是可用性和負責任的實施。

“我們在這項工作中的主要目標是使新手用戶能夠以創造性和靈活的方式生成視覺內容。但是,有濫用使用我們的技術創建假或有害內容的風險,我們認為,為了確保安全和公平的用途,可以開發和應用工具來開發和應用工具,以開發和應用工具來檢測偏見和惡意用例。”