Meta 的新主要語言模型 Llama 3.1 希望與該領域的大牌 GPT-4o 和 Claude 3.5 Sonnet 並肩。他口袋裡有一張王牌可以贏得賭注:該模型是開源的,因此每個人都可以免費使用。

«開源人工智慧對世界有利»,斷言馬克‧祖克柏。秉持著這樣的信念,創辦人兼老闆元宣布免費開放分送駱駝3.1,該公司開發的大語言模型(LLM)的新“豐富”版本。事實上,共有三種模型:8B 模型(80 億個參數)、70B(700 億個參數)和最大的 405B(4,050 億個參數)。

針對蘋果及其封閉模式的攻擊

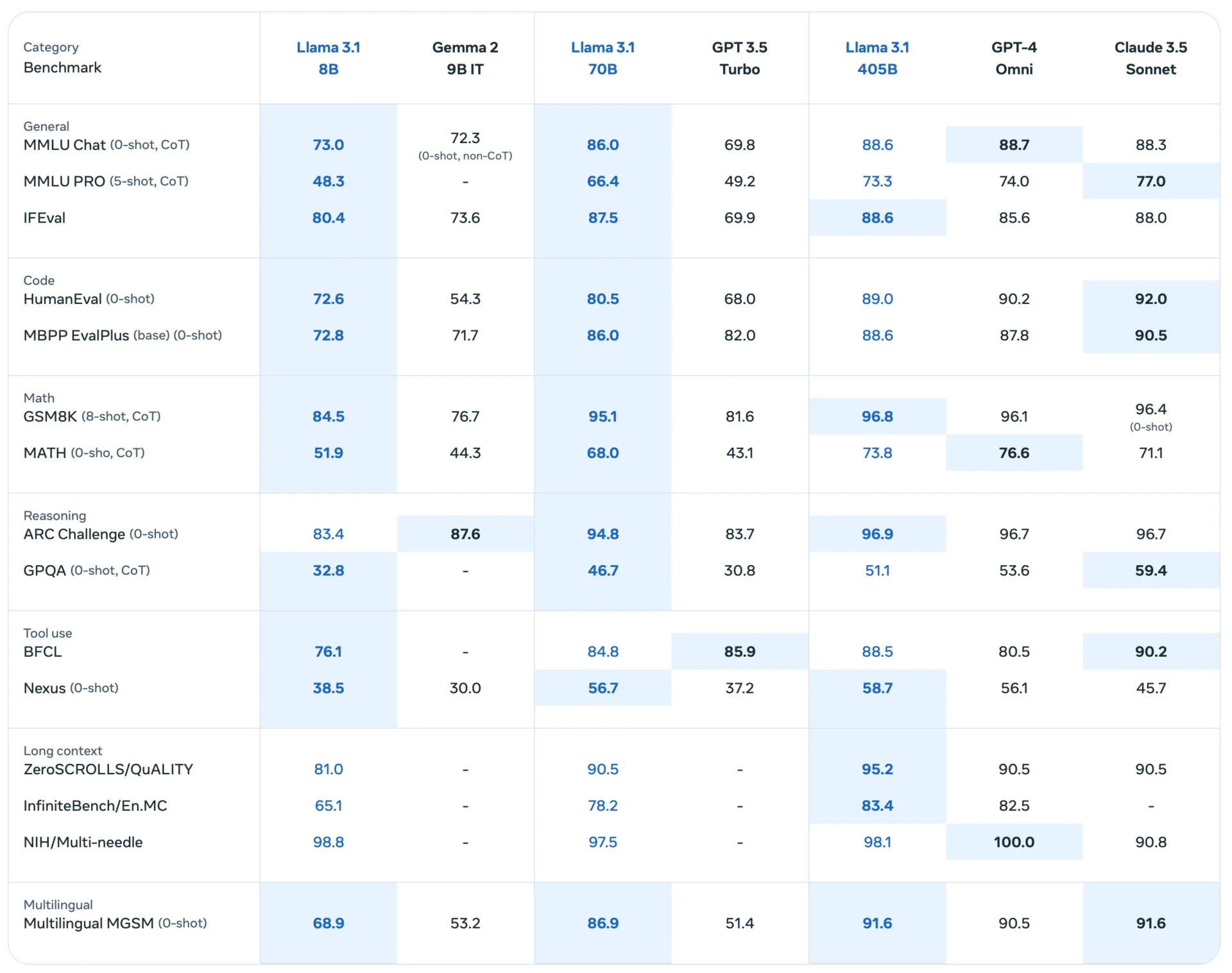

參數的數量是模型容量的衡量標準,它並不是唯一必須考慮的因素(訓練資料的品質也同樣重要)。但面對 OpenAI 的激烈競爭,Meta 想要給予重擊(GPT-4o)和人類(克勞德 3.5 十四行詩),因此透過在 16,000 個 Nvidia H100 GPU 上訓練 Llama 3.1 來給自己提供了方法。

儘管 LLM 培訓產生了成本,但 Meta 仍將其作為向社區的「禮物」。馬克·祖克柏堅信:開放的人工智慧模型將取代專有模型,就像 Linux 已成為雲端運算產業的基礎以及大多數行動裝置運行的作業系統一樣。

如果我們必須看看人類從 Llama 中得到什麼,這對 Meta 有什麼好處?馬克·祖克柏討論了他的公司與蘋果公司遇到的挫折:

「我的成長經歷之一是在蘋果平台施加的限制下開發我們的服務。從他們向開發者徵稅的方式、他們執行的任意規則,以及他們阻止的所有產品創新,很明顯,如果我們能夠開發出最好的版本,Meta 和許多其他公司需要自由地為用戶提供更好的服務我們的產品,而我們的競爭對手無法限制我們的創造。

為了避免被鎖定在封閉的生態系統中,Llama 必須成為一個完整的生態系統,擁有隻有開源才能提供的工具、效率、晶片優化和其他整合。此外,出售人工智慧模型的存取權並不是 Meta 的商業模式:以開源方式發布 Llama 不會損害收入或投資研究的能力。

這也是一種公平的回報,知道 Meta 有“節省了數十億» 感謝開放運算項目等項目,並透過發布 PyTorch 和 React 等工具從生態系統創新中受益。 Meta 並未等到 7 月 23 日就開始發號施令:25 位合作夥伴都參與其中,包括 Nvidia、Amazon Web Services、Google Cloud、SNCF Gares & Connexions 等。

SNCF Gares & Connexions 正在試驗 Llama 3.1 的新功能,包括法語、英語、德語、西班牙語、義大利語和葡萄牙語的多語言資訊和旅客定位。為了加強該系統,還可以透過 WhatsApp 聊天機器人獲得快速、個人化的體驗,該機器人為旅客提供即時訊息,例如他們前往車站的資訊。

如果 Meta 願意打透明度牌來提升其新法學碩士的能力,那麼另一方面,它總是對了解更多有關培訓數據的資訊守口如瓶,這被認為是行業機密。 Meta 簡單地解釋說它使用“綜合數據» 由模型而非人類產生。如何避免掠奪審判?沒有什麼比這更確定的了。

同時,公司還矛Meta AI 助理的多語言版本現已在 22 個新國家推出。該服務已整合到 WhatsApp、Instagram、Messenger 和 Facebook 應用程式中,現在支援法語、德語、西班牙語甚至葡萄牙語。另一方面,它在歐盟仍然不可用,並且不可能很快發生。

來源 : 元