英伟达是生成式人工智能技术蓬勃发展的关键。该行业的很大一部分依赖于 Nvidia 的 GPU 和服务器的功能。该公司并不想就此止步。事实上,它将销售一款供研究人员使用的迷你电脑,数据科学家以及对学生;这台“AI 超级计算机”将允许他们使用大型语言模型 (LLM),参数高达 2000 亿个。

桌面上的主要语言模型

大型语言模型的参数是允许法学硕士进行预测或生成文本的元素。参数是模型用来定义神经网络不同组件之间的内部连接的数字。简而言之,每个参数就好像一个小尺子或权重,可以帮助模型理解单词、概念或想法之间的关系。

举个例子,Llama(Meta 最好的 LLM)的 3.1 版本拥有 4050 亿个参数。可以这么说,通过这个“数字项目”,Nvidia 提供了一台已经非常强大的机器,特别是因为实际上可以连接其中两个来运行 4050 亿个参数。用户将能够在本地创建原型并测试模型。

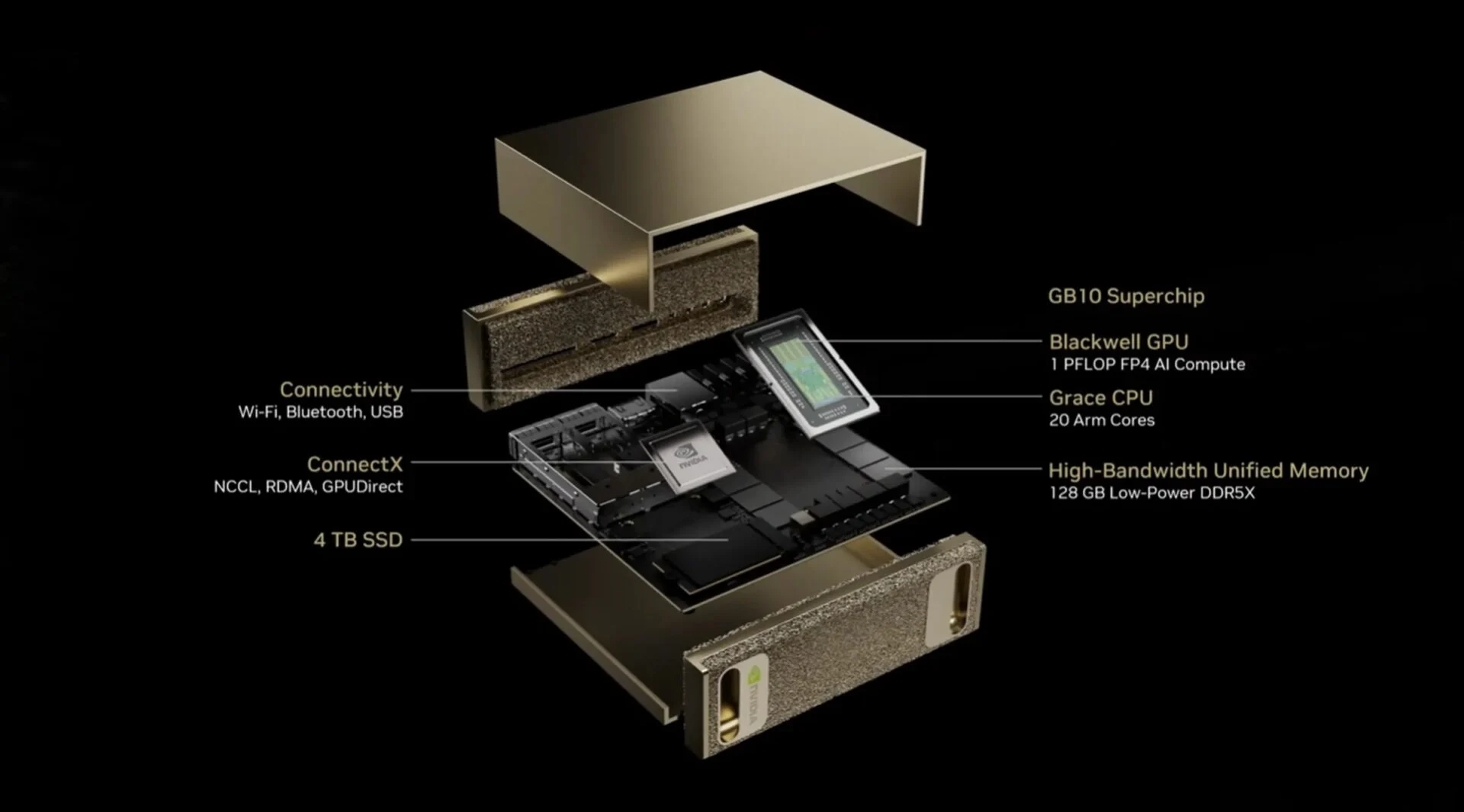

该计算机的核心是 GB10 Superchip,这是一种基于 Grace Blackwell 架构的片上系统 (SoC),能够提供高达 1 petaflop 的 AI 性能。该芯片结合了包含下一代 CUDA 核心和第五代 Tensor 核心的 GPU,并借助 NVLink-C2C 互连系统连接到 Grace CPU(20 个高效的 Arm 架构核心)。联发科帮助开发了这款新引擎。

为了给这一切提供燃料,不需要核反应堆附近:一个简单的标准电源插座就足够了。每台迷你 PC 均包含 128 GB 统一内存和高达 4 TB 的 SSD 存储。一切的设计都让人想起 Mac mini。

Project Digits 将于 5 月上市,起价为 3,000 美元。人工智能要花钱!

来源 : 英伟达