邁克爾·利特曼(Michael Littman)是布朗大學計算機科學教授。他是布朗以人類為中心的機器人技術計劃的共同領導者,該計劃旨在記錄人類機器人互動研究的社會需求和應用以及其發展隨之而來的道德,法律和經濟問題。利特曼(Littman)為現場科學的專家聲音:專家和見解。

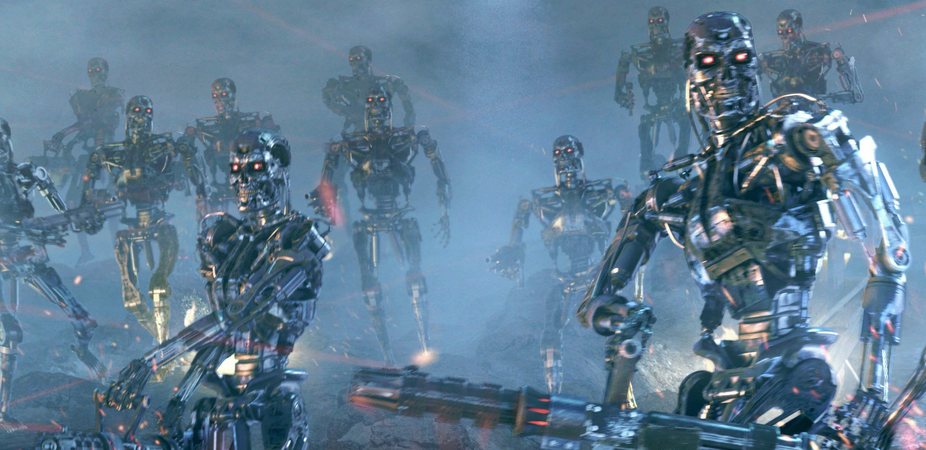

每項新技術都帶來了自己的噩夢。人工智能(AI)和機器人技術也不例外。確實,“機器人”一詞是為1920年的戲劇創造的,這使得人類的世界末日戲劇化。

本月早些時候關於AI未來的公開信,由許多備受矚目的科學家和企業家簽署,刺激了一輪令人痛苦的頭條新聞,例如“頂級科學家對人工智能有不祥的警告”和“人工智能專家承諾保護人類免受機器的侵害”。這意味著機器有一天會取代人類。

讓我們直截了當:一個世界被我們自己創作的超級智能機器奴役或摧毀的世界純粹是科幻小說。像其他所有技術一樣,AI都有風險和好處,但是我們不能讓恐懼主導對話或指導AI研究。

然而,大幅度改變AI研究議程以專注於AI“安全”的想法是一個自稱為“生命研究所未來(FLI)的未來”的主要信息。 FLI包括少數深思的思想家和公眾人物埃隆·馬斯克(Elon Musk)斯蒂芬·霍金(Stephen Hawking)和擔心人類被強大的計劃融入的那一天。 [專家說,智能機器人將在2100年到2100這是給出的

正如書中描述的那樣”超級智能:路徑,危險,策略”(牛津大學出版社,2014年),由FLI顧問委員會成員和位於牛津的哲學家尼克·博斯特羅姆(Nick Bostrom)展開的三個部分。在第一部分(大約是我們現在的位置),計算能力和智能軟件在越來越多的步伐中通過科學家和工程師的辛勞來越來越多。在第三次也是最後一個行為中,一個失控的“情報爆炸”。

讓我們仔細看看這個世界末日的故事情節。在這三個部分中,第一個確實正在發生,而Bostrom為當前和近距離的技術提供了刻薄而啟發性的瞥見。第三部分是探索Supersmart機器的後果的哲學上。正是第二部分 - 情報爆炸 - 明顯地違反了我們對計算機科學和自然情報的了解。 [AI的歷史:人工智能(信息圖)這是給出的

失控的情報?

情報爆炸的概念來自摩爾定律,這一觀察結果是,自1950年代以來,計算機的速度一直在呈指數增長。將這種趨勢向前投影,我們將在未來幾十年內看到具有整個人類的計算能力的計算機。但是,從這個想法轉變為機器智能的未經檢查的增長是一個飛躍。

首先,創造力不是開發更快計算機的唯一瓶頸。這些機器需要實際構建,這需要現實世界中的資源。確實,摩爾的定律也呈指數增長的生產成本 - 精確電子產品的大規模生產並不便宜。此外,存在基本的物理定律(量子限制),這限制了晶體管能夠完成其工作的速度。非矽技術可能會克服這些限制,但是這種設備仍然高度投機。

除了物理定律外,我們對計算及其限制的基本性質了解很多。例如,一些計算難題,例如弄清楚如何考慮一個數字並因此破解在線加密方案,通常認為任何快速程序都無法解決。它們是一類數學定義的問題的一部分,這些問題是“ NP完整”的,這意味著它們與在多項式時間(P)中無確定性(n)的任何問題完全一樣困難,並且它們已經抵制了任何可擴展解決方案的嘗試。事實證明,我們與人類智能相關的大多數計算問題都在此類中。 [高級人工智能有多聰明?嘗試學前班級別這是給出的

等一下,您可能會說。人的思想如何設法解決計算機科學家認為無法解決的數學問題?我們沒有。總的來說,我們作弊。我們建立了一個我們感興趣的世界元素的卡通精神模型,然後探究了這一發明的迷你世界的行為。在這些想像中的縮影中,完整性與拖延性之間存在權衡。我們提出,思考和項目可靠期貨的能力是以準確性為代價的。即使允許存在比今天更快的計算機的可能性,這些計算機能夠比現實本身更快地準確地模擬現實是合乎邏輯的。

反對反對事業

面對人工智能和計算機科學社區中關於情報爆炸可能性的普遍懷疑,FLI仍然希望為其事業贏得支持。該組織的信呼籲越來越關注以最大程度地提高發展AI的社會利益。我尊敬的許多同事都簽署了這封信,以表示他們對避免潛在技術陷阱的重要性的支持。但是,在信中,諸如“我們的AI系統必須做我們想做的事情”之類的信件中的一些關鍵短語被媒體作為承認AI研究人員認為他們可能正在創造“無法控制”的東西。這也意味著AI的研究人員在方向盤上睡著了,忽略了不祥的可能性,這簡直是不真實的。 [人工智能:友好還是令人恐懼?這是給出的

需要明確的是,確實對AI的近期未來(算法交易者崩潰了經濟崩潰,或者敏感的電網都過度反應並關閉了大量人群的電力,這確實引起了人們的擔憂。人們還擔心,學術界和行業內的系統性偏見阻止了代表性不足的少數群體參與並幫助引導信息技術的增長。這些擔憂應該在新思想的發展和部署中發揮核心作用。但是,對計算機突然醒來並打開我們的恐懼預測根本不現實。

我歡迎關於如何使AI變得強大和有益的公開討論,以及我們如何設計使社會變得更好的智能機器和系統。但是,請讓討論牢固地置於理性領域,並將機器人起義留給好萊塢編劇。

遵循所有專家聲音問題,並成為討論的一部分 - 並成為討論的一部分Facebook,,,,嘰嘰喳喳和Google+。表達的觀點是作者的觀點,不一定反映出版商的觀點。該文章的此版本最初發表在現場科學。