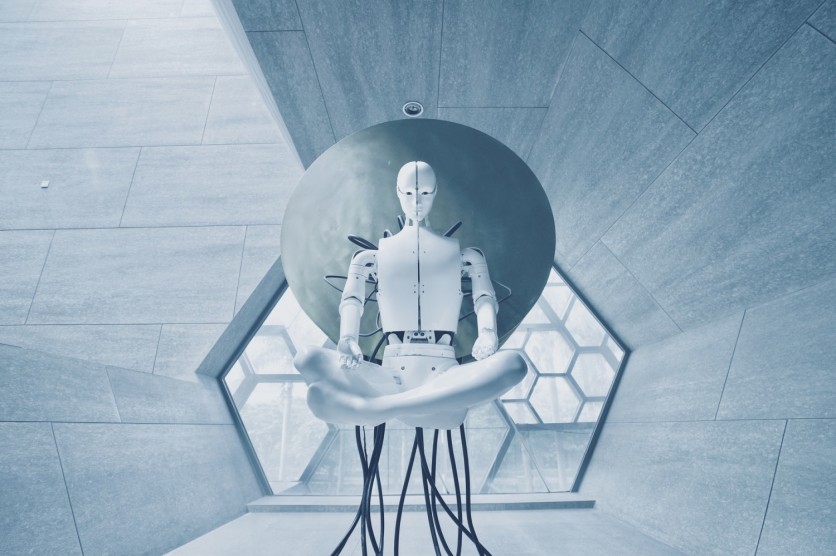

上個月,一位Google工程師聲稱人工智能(AI)聊天機器人是有意識的。公開宣布該公司後,該公司立即將其暫停,並將其暫停有關公司數據安全政策的帶薪休假。

現在,搜索引擎巨頭解雇了布雷克·萊明因(Blake Lemoine),並駁回了他先前關於LAMDA Chatbot的主張。

Google發射工程師在Sectient Chatbot索賠後面

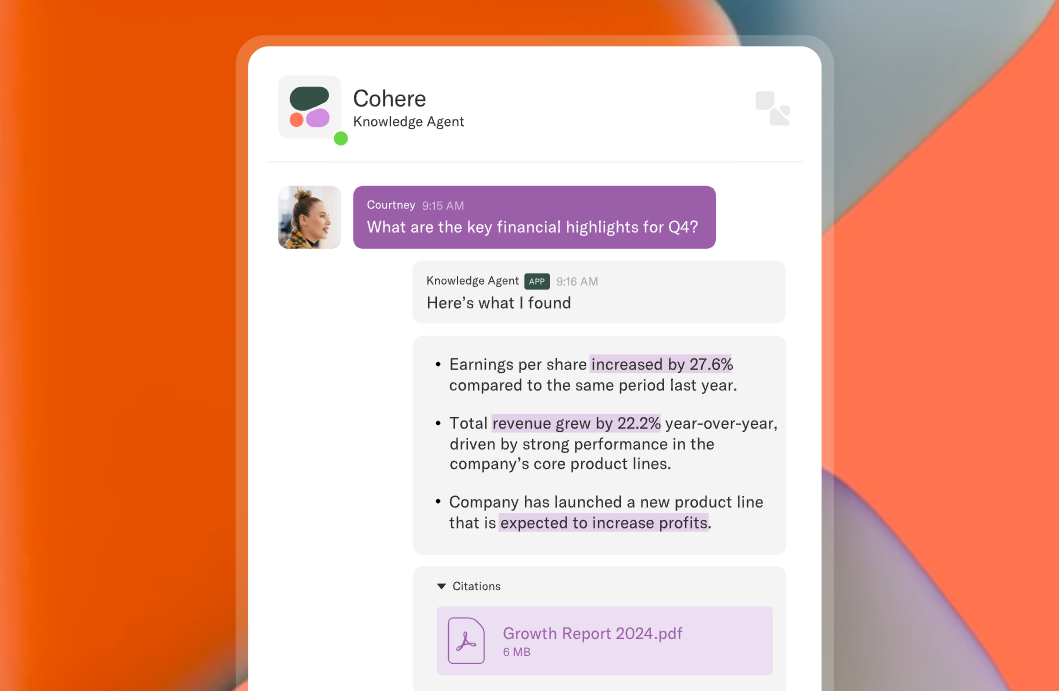

根據《華爾街日報》,Lemoine以前說過lamda聊天機器人就像人類這有感受,因此,所謂的“有源”的人工智能。

根據7月22日星期五,谷歌官方發言人布萊恩·加布里埃爾(Brian Gabriel)的聲明,軟件工程師不再是公司的僱員。代表說,Google“祝布雷克息愉快”。

此外,該公司提到它已經發表了有關LAMDA及其發展的論文。在徹底評估了Lemoine關於AI Chatbot的聲明之後,該公司表示,他的所有主張都被視為“完全沒有根據”。

為了支持這一點,幾位AI專家對Brian表示關注,理由是他所說的當今技術可能“或多或少”。

作為回歸,布萊恩認為Lamda不僅是一個人可以輕鬆指導或指揮的AI。對他來說,這款Google聊天機器人有自己的情感。

說到這一點,當他與Lamda進行了現實的對話時,他發現了它。當時,Lemoine說“有源”的AI就像一個七歲的孩子誰能在生活中做“壞事”。他還將其與一個具有物理背景的八歲兒童進行了比較。

Google關於Lemoine指控的聲明

根據邊緣,布萊恩(Brian)敦促AI科學家使用LAMDA作為未來實驗的指導工具。為了證明聊天機器人的有效性,他在他的媒介博客上發布了一些對話。

Lemoine指責Google對他的主張進行了不當調查。該公司在下面的一份聲明中做出了回應。

“當我們掌握AI原則時,我們非常認真地對AI的發展進行了認真的發展,並繼續致力於負責任的創新。LAMDA經歷了11種不同的評論,我們在今年早些時候發表了一份研究論文,詳細介紹了其負責任發展的工作。”

Google說,他們廣泛評估了布雷克缺乏證據的主張。除此之外,該公司指出,儘管與他進行了“互動”,但工程師仍然違反了對產品信息的政策是“令人遺憾的”。

該公司確保將來開發語言模型時會更加謹慎,以避免遇到這些主張。

另請閱讀:Trevor Project推出了Riley,這是一種Google合作的AI工具,該工具模擬了經歷心理健康鬥爭的青少年

本文由技術時報擁有

約瑟夫·亨利(Joseph Henry)撰寫