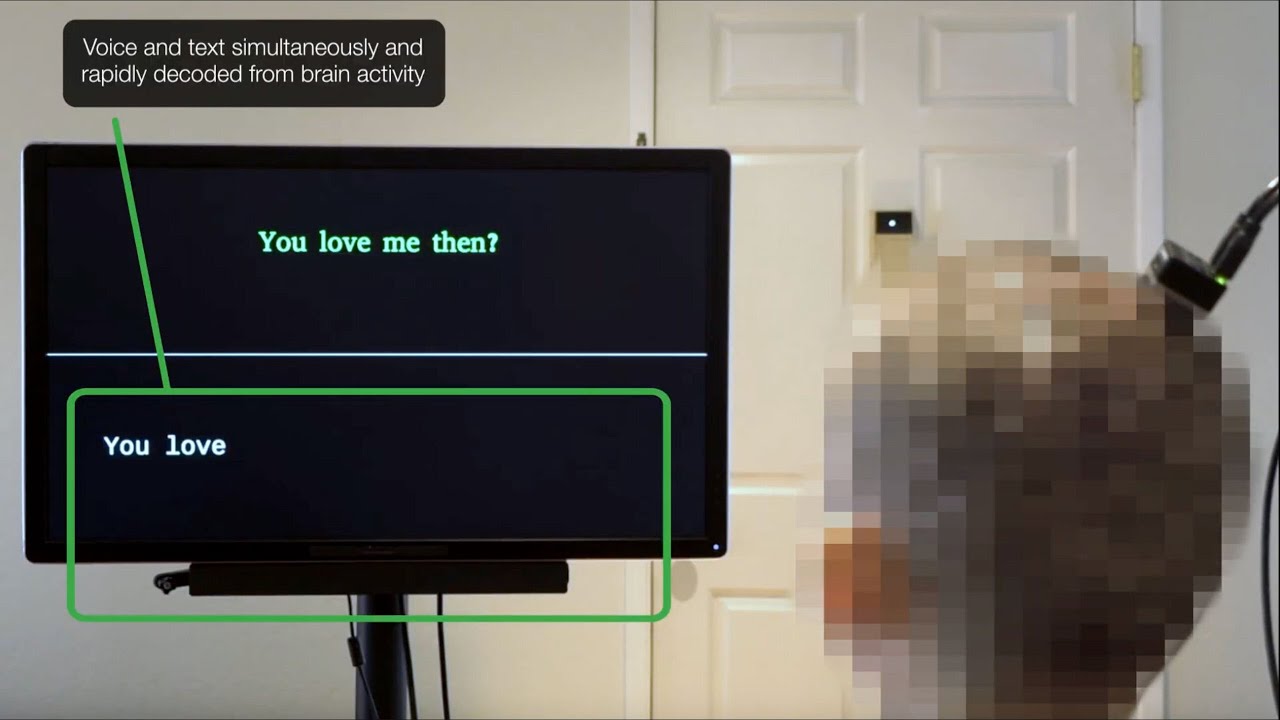

การฝังสมองที่ใช้(AI) เกือบจะสามารถถอดรหัสความคิดของบุคคลได้ทันทีและสตรีมผ่านลำโพงการวิจัยใหม่แสดงให้เห็น นี่เป็นครั้งแรกที่นักวิจัยประสบความสำเร็จในการสตรีมมิ่งสมองถึงเสียง

เทคโนโลยีการอ่านใจทดลองได้รับการออกแบบมาเพื่อให้เสียงสังเคราะห์แก่ผู้ที่มีอัมพาตอย่างรุนแรงซึ่งไม่สามารถพูดได้ มันทำงานได้โดยการวางขั้วไฟฟ้าลงบนพื้นผิวของสมองซึ่งเป็นส่วนหนึ่งของรากฟันเทียมที่เรียกว่ากระบบประสาทซึ่งช่วยให้นักวิทยาศาสตร์สามารถระบุและตีความสัญญาณการพูด

อินเทอร์เฟซ Brain-Computer (BCI) ใช้ AI เพื่อถอดรหัสสัญญาณประสาทและสามารถสตรีมคำพูดที่ตั้งใจไว้จากสมองในระยะเวลาใกล้เคียงจริงตามคำสั่งที่เผยแพร่โดยมหาวิทยาลัยแห่งแคลิฟอร์เนีย (UC), Berkeley- ก่อนหน้านี้ทีมเปิดตัวไฟล์เวอร์ชันก่อนหน้าของเทคโนโลยีในปี 2023 แต่เวอร์ชันใหม่นั้นเร็วกว่าและหุ่นยนต์น้อยกว่า

การสตรีมระบบประสาทไปสู่สมองเพื่อฟื้นฟูการสื่อสารตามธรรมชาติ-YouTube

"วิธีการสตรีมของเรานำความสามารถในการถอดรหัสการพูดอย่างรวดเร็วของอุปกรณ์เช่น Alexa และ Siri มาสู่ระบบประสาท"Gopala Anumanchipalliผู้ช่วยศาสตราจารย์ด้านวิศวกรรมไฟฟ้าและวิทยาศาสตร์คอมพิวเตอร์ที่ UC Berkeley กล่าวในแถลงการณ์ "การใช้อัลกอริทึมประเภทเดียวกันเราพบว่าเราสามารถถอดรหัสข้อมูลระบบประสาทและเป็นครั้งแรกที่เปิดใช้งานการสตรีมเสียงที่ใกล้เคียงกัน"

Anumanchipalli และเพื่อนร่วมงานของเขาแบ่งปันผลการวิจัยของพวกเขาในการศึกษาที่ตีพิมพ์เมื่อวันจันทร์ (31 มีนาคม) ในวารสาร-

ที่เกี่ยวข้อง:

คนแรกที่ทดลองใช้เทคโนโลยีนี้ระบุว่าแอนประสบกับโรคหลอดเลือดสมองในปี 2548 ที่ทำให้เธอเป็นอัมพาตอย่างรุนแรงและไม่สามารถพูดได้ เธอได้อนุญาตให้นักวิจัยปลูกฝังอิเล็กโทรด 253 ตัวลงในสมองของเธอเพื่อตรวจสอบส่วนหนึ่งของสมองของเราที่ควบคุมการพูด - เรียกว่ามอเตอร์เยื่อหุ้มสมอง - เพื่อช่วยพัฒนาเทคโนโลยีการพูดสังเคราะห์

“ เรากำลังสกัดกั้นสัญญาณที่ความคิดถูกแปลเป็นเสียงที่เปล่งออกมาและในช่วงกลางของการควบคุมมอเตอร์นั้น” ผู้เขียนร่วมการศึกษาThoole One Choนักศึกษาปริญญาเอกสาขาวิศวกรรมไฟฟ้าและวิทยาศาสตร์คอมพิวเตอร์ที่ UC Berkeley กล่าวในแถลงการณ์ “ ดังนั้นสิ่งที่เราถอดรหัสคือหลังจากความคิดเกิดขึ้นหลังจากที่เราตัดสินใจว่าจะพูดอะไรหลังจากเราตัดสินใจว่าจะใช้คำอะไรและวิธีการย้ายกล้ามเนื้อเสียงร้องของเรา”

AI ถอดรหัสข้อมูลตัวอย่างโดยการปลูกถ่ายเพื่อช่วยแปลงกิจกรรมของระบบประสาทให้เป็นคำพูดสังเคราะห์ ทีมฝึกอัลกอริทึม AI ของพวกเขาโดยให้แอนพยายามพูดประโยคที่ปรากฏบนหน้าจอต่อหน้าเธออย่างเงียบ ๆ และจากนั้นโดยการจับคู่กิจกรรมประสาทกับคำที่เธอต้องการพูด

ระบบตัวอย่างสัญญาณสมองทุก ๆ 80 มิลลิวินาที (0.08 วินาที) และสามารถตรวจจับคำและแปลงเป็นคำพูดด้วยความล่าช้าสูงสุดประมาณ 3 วินาทีตามการศึกษา นั่นค่อนข้างช้าเมื่อเทียบกับการสนทนาปกติ แต่เร็วกว่าเวอร์ชันก่อนหน้าซึ่งมีความล่าช้าประมาณ 8 วินาทีและสามารถประมวลผลประโยคทั้งหมดได้เท่านั้น

ระบบใหม่ได้รับประโยชน์จากการแปลง Windows ที่สั้นกว่าของกิจกรรมประสาทมากกว่าแบบเก่าดังนั้นจึงสามารถประมวลผลคำแต่ละคำได้อย่างต่อเนื่องแทนที่จะรอประโยคที่เสร็จแล้ว นักวิจัยกล่าวว่าการศึกษาใหม่เป็นขั้นตอนหนึ่งในการบรรลุคำพูดสังเคราะห์ที่ทำให้เกิดเสียงที่เป็นธรรมชาติมากขึ้นด้วย BCIS

“ กรอบการพิสูจน์แนวคิดนี้ค่อนข้างก้าวหน้า” โชกล่าว "เรามองโลกในแง่ดีว่าตอนนี้เราสามารถสร้างความก้าวหน้าได้ในทุกระดับเช่นด้านวิศวกรรมเช่นเราจะผลักดันอัลกอริทึมต่อไปเพื่อดูว่าเราสามารถสร้างคำพูดได้ดีขึ้นและเร็วขึ้น"