生成的力量可能已经很可怕了,但没有任何形式的保护或保障是 DeepSeek 现在正在处理的一个主要问题。据报道,它缺乏必要的保护措施,使其成为恶意利用者的最爱。

DeepSeek AI:分析师称没有保障措施,只有保护

以色列研究公司 ActiveFence 的一份报告(来自YNetNews.com)透露,中国人工智能初创公司在运营方面严重缺乏要点,这可能会在未来导致严重问题。首先,团队发现 DeepSeek 的人工智能尽管在全球范围内大规模运营,但没有任何形式的保障措施。

该团队在最新调查结果中报告称,该公司没有针对用户帐户采取任何内部或外部保护措施,并且可能会被那些希望利用它的人出于错误的原因使用。

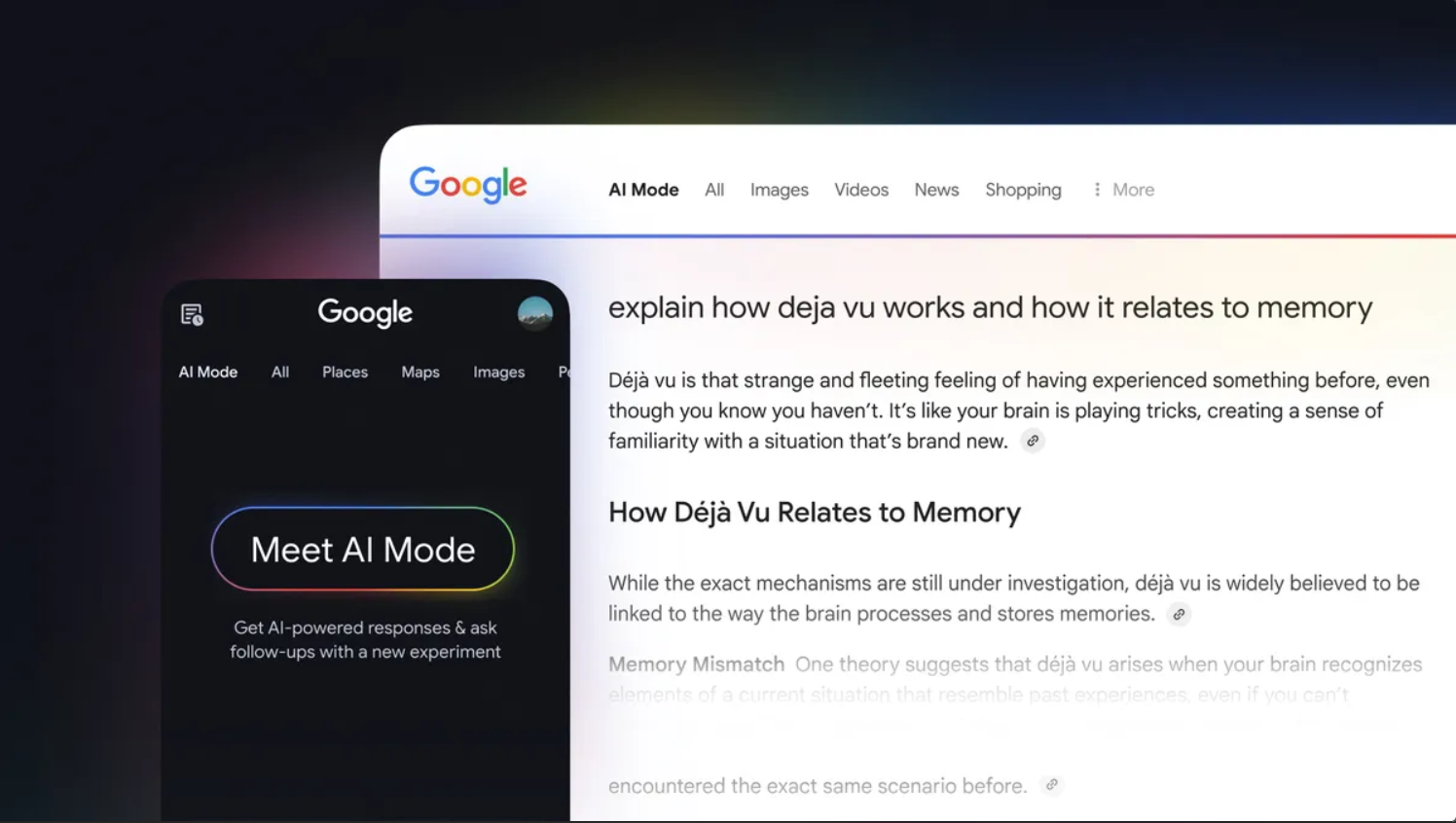

据透露,DeepSeek 与 OpenAI、Google、Perplexity 等西方同行不同,后者制定了有关其使用的指南和政策。对于人工智能和非人工智能用户来说,缺乏政策和保障措施是一个重大问题。

根据该报告,犯罪分子有可能利用 DeepSeek 的服务,利用其技术实施诈骗,将公众引入不同的场景。

ActiveFence测试了DeepSeek的V3人工智能,重点关注危险提示。研究发现,有害反应的比例高达 38%。

在这个时代使用生成式人工智能的罪恶

尽管人工智能是一种几乎无所不知、无所不能的技术,但并不是所有可以想象的话题都可供用户与机器讨论。涉及人工智能的犯罪显着上升,并受到当局、人工智能公司和其他相关团体的积极阻止。

去年,人工智能的错误使用有所增加,许多不良行为者诉诸先进技术知名人士误导公众接受宣传信仰等。然而,其他人则利用深度伪造技术来制造更令人发指的在线活动,例如人工智能生成的色情内容,从而使未成年人受害。

目前,一些政府正在制定立法和法规,以防止用户之间。