人工智能必须是“大胆、负责”。昨天 Google I/O 的开幕主题演讲中也强调了这一主题。山景城巨头技术与社会部门负责人詹姆斯·马尼卡(James Manyika)扮演了一位富有冒险精神、有远见的人,但也意识到了自己的责任,他有机会谈论谷歌的危险和职责。

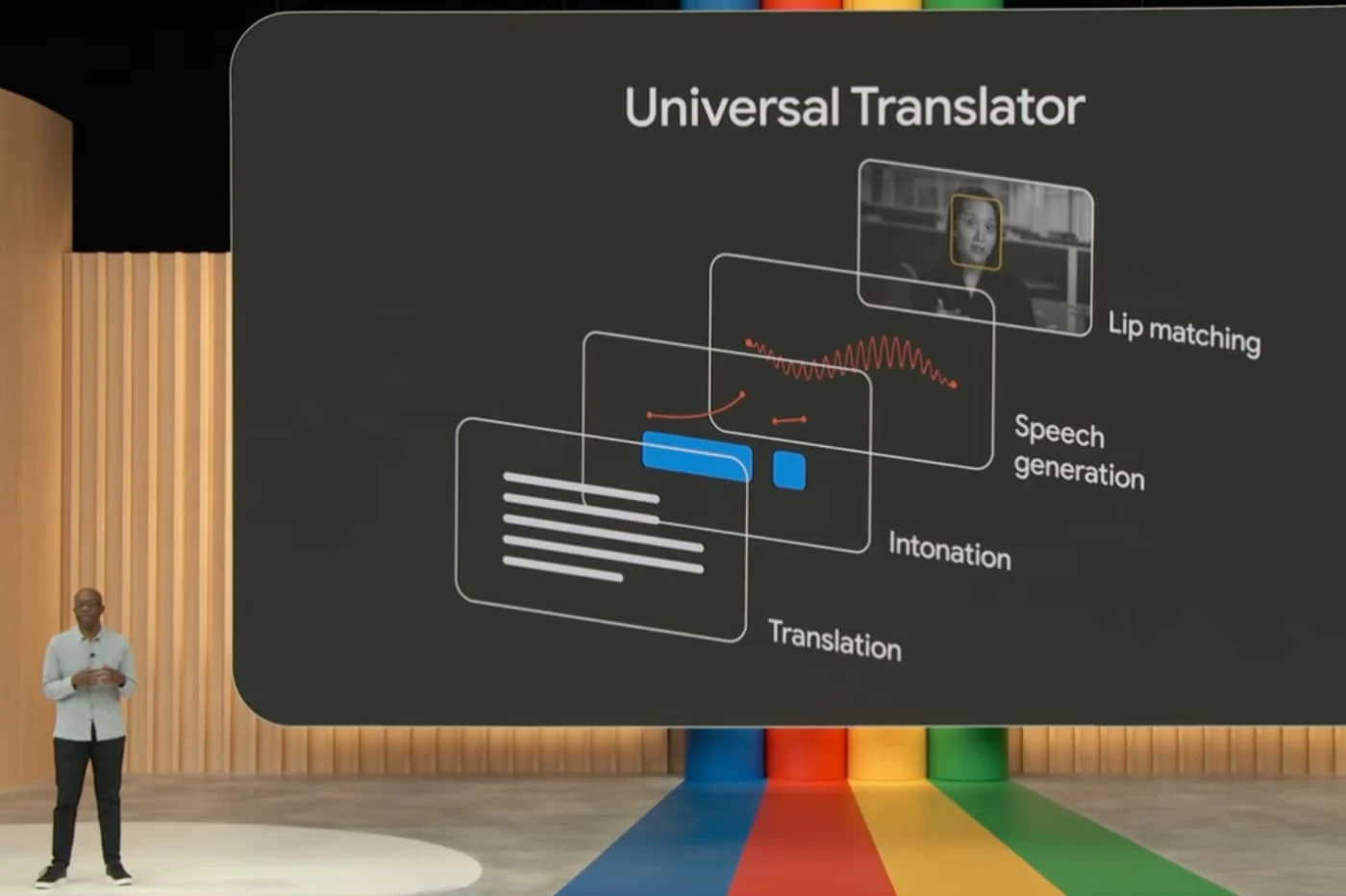

他也是万能翻译器的发明者。在一个充满革命或潘多拉魔盒的世界里,这是一个拥有一切的工具假新闻和的深度假货。在所呈现的示例的上下文中,可以从用英语录制的视频(在本例中为一门课程)转录视频内容,然后进行翻译。到目前为止,没有什么特别的。然后,它会重现说话者的语调,并将其应用于另一种语言的合成语音,例如西班牙语,以进行演示。这令人印象深刻,但其本身并不一定令人担忧。到了下一步,事情就会变得复杂。

事实上,通用翻译器会同步视频中拍摄的原始说话者的嘴唇动作,以便他给人以目标语言发音的印象......应用案例很多,无论是在教育或商业领域,但现实和修改后的现实之间正在消失的新障碍清楚地表明,存在潜在的问题和滥用行为,即使并非一切都已解决。技术上仍然是最佳的。

詹姆斯·马尼卡发言“大胆与责任之间的紧张关系”。这就是为什么他从一开始就宣布,这项服务不仅是完全实验性的,而且并不打算向所有人开放,而只是向精心挑选的合作伙伴开放。

我们还希望这个项目的发展能够受到谷歌2018年颁布的有关人工智能的七项规则的约束。

- 对社会有益

- 避免产生或强化偏见

- 设计和测试时均考虑到安全性

- 对用户负责

- 整合隐私友好原则

- 保持科学卓越的严格标准

- 可用于符合这些原则的用途。

几分钟后詹姆斯·马尼卡 (James Maniyka) 回忆道,人工智能的这些相同原理帮助巨人“决定不做什么”。例如,他解释说,这些是多年前阻止谷歌进入通用面部识别 API 的原则,因为“当时的担保还不够充分”。在 OpenAi 之前,阻止 Google 按下 ChatGPT 等效项上的启动按钮的原则是否相同?或许。对于 James Maniyka 来说,解决方案之一是“应对出现的挑战”感谢创新和对某种道德的尊重,这几乎看起来像《不要作恶》。

无论如何,在这些原则的影响下,谷歌在设计通用翻译器时都会采取保护措施,以避免危险的使用。此外,以这种方式处理的视频应遵守 James Manyika 宣布的预防措施。因此,谷歌应该尽快“将新的水印创新融入[会话]最新的生成模型有助于防范错误信息 »。

如果很难知道所有这些预防措施到底包括哪些内容,如果谷歌明确表示要控制其技术的使用,那么我们必须牢记去年春初 Meta 人工智能模型的泄露。一方面,泄露为滥用打开了大门,但另一方面,由于开源世界抓住了它,也成为了这一事业的加速器。恶与善,再一次。谷歌知道这一点,并寻求在上游采取行动来保护自己,使我们免受最坏的影响,在这样的背景下,似乎不可能对一个快速发展并受到关键地缘战略问题干扰的领域实施暂停。最终,我们总是回到大胆与责任之间的剃刀边缘。如果万能翻译器拥有潘多拉魔盒中的一切。让我们不要忘记,在这个神话般的宝箱底部永远存在着希望。

Opera One - AI 驱动的网络浏览器

作者:歌剧

来源 : Google I/O 2023 开幕大会