大脑植入物使用新的研究表明,人工智能几乎可以立即解码一个人的想法并将其通过扬声器传输。这是研究人员首次实现近同步的大脑到语音流传输。

这项实验性读心技术旨在为无法说话的严重瘫痪患者提供合成声音。它的工作原理是将电极放置在大脑表面,作为植入物的一部分,称为“植入物”。神经假体,这使得科学家能够识别和解释语音信号。

用于恢复自然交流的流式大脑到语音神经假体 - YouTube

“我们的流媒体方法为神经假体带来了与 Alexa 和 Siri 等设备相同的快速语音解码能力,”研究联合首席研究员戈帕拉·阿努曼奇帕利加州大学伯克利分校电气工程和计算机科学助理教授在声明中表示。 “使用类似类型的算法,我们发现我们可以解码神经数据,并首次实现近同步语音流。”

Anumanchipalli 和他的同事在周一(3 月 31 日)杂志上发表的一项研究中分享了他们的发现。

有关的:

第一个尝试这项技术的人名叫 Ann,她在 2005 年中风,导致她严重瘫痪并且无法说话。此后,她允许研究人员在她的大脑中植入 253 个电极,以监测我们大脑中控制语音的部分(称为运动皮层),以帮助开发合成语音技术。

“我们本质上是在拦截信号,将思想转化为表达方式,并在运动控制的中间进行,”研究的共同主要作者图勒一乔,加州大学伯克利分校电气工程和计算机科学专业的博士生在声明中说道。 “所以我们正在解码的是在一个想法发生之后,在我们决定要说什么之后,在我们决定使用什么词语以及如何移动我们的声道肌肉之后。”

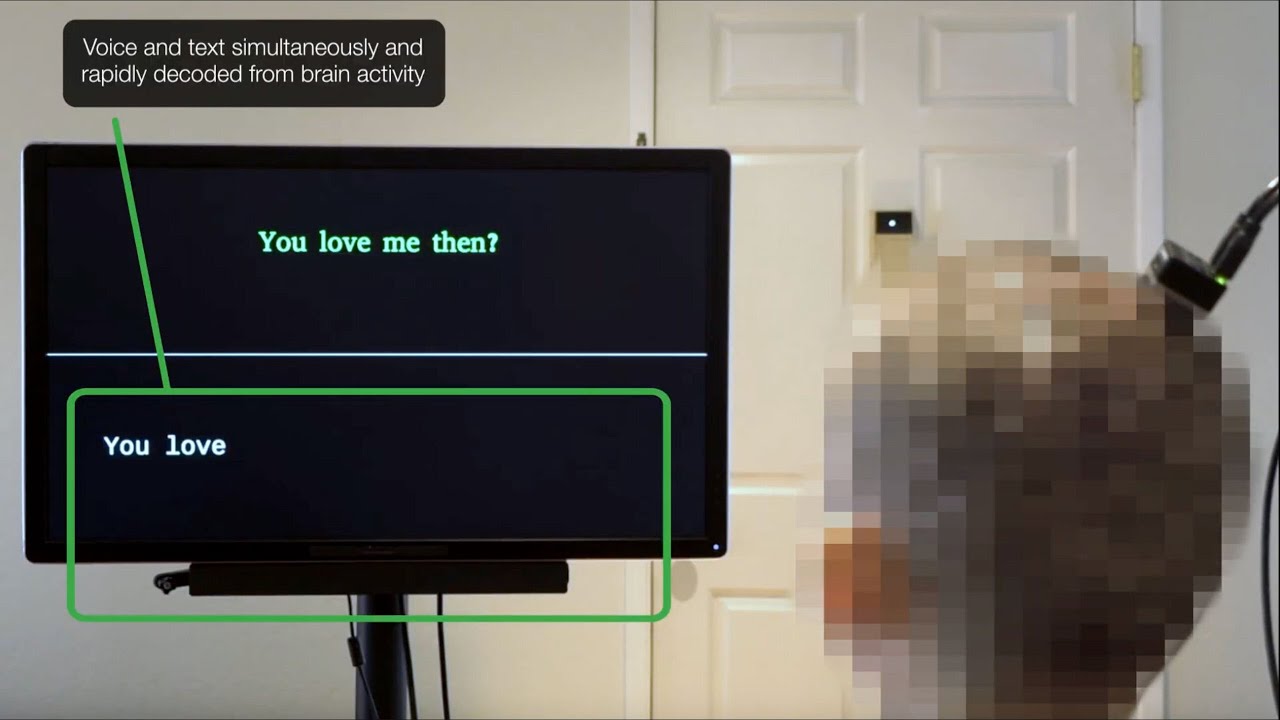

人工智能对植入物采样的数据进行解码,以帮助将神经活动转换为合成语音。该团队通过让安默默地尝试说出出现在她面前的屏幕上的句子,然后将神经活动与她想说的单词进行匹配来训练他们的人工智能算法。

研究表明,该系统每 80 毫秒(0.08 秒)对大脑信号进行一次采样,并且可以检测单词并将其转换为语音,延迟最多约为 3 秒。与正常对话相比,这有点慢,但比之前的版本要快,之前的版本有大约 8 秒的延迟,而且只能处理整个句子。

新系统受益于转换比旧系统更短的神经活动窗口,因此它可以连续处理单个单词,而不是等待完成的句子。研究人员表示,这项新研究是朝着利用脑机接口实现听起来更自然的合成语音迈出的一步。

“这个概念验证框架是一个相当大的突破,”Cho 说。 “我们乐观地认为,我们现在可以在各个层面取得进步。例如,在工程方面,我们将继续推动算法,看看如何更好更快地生成语音。”