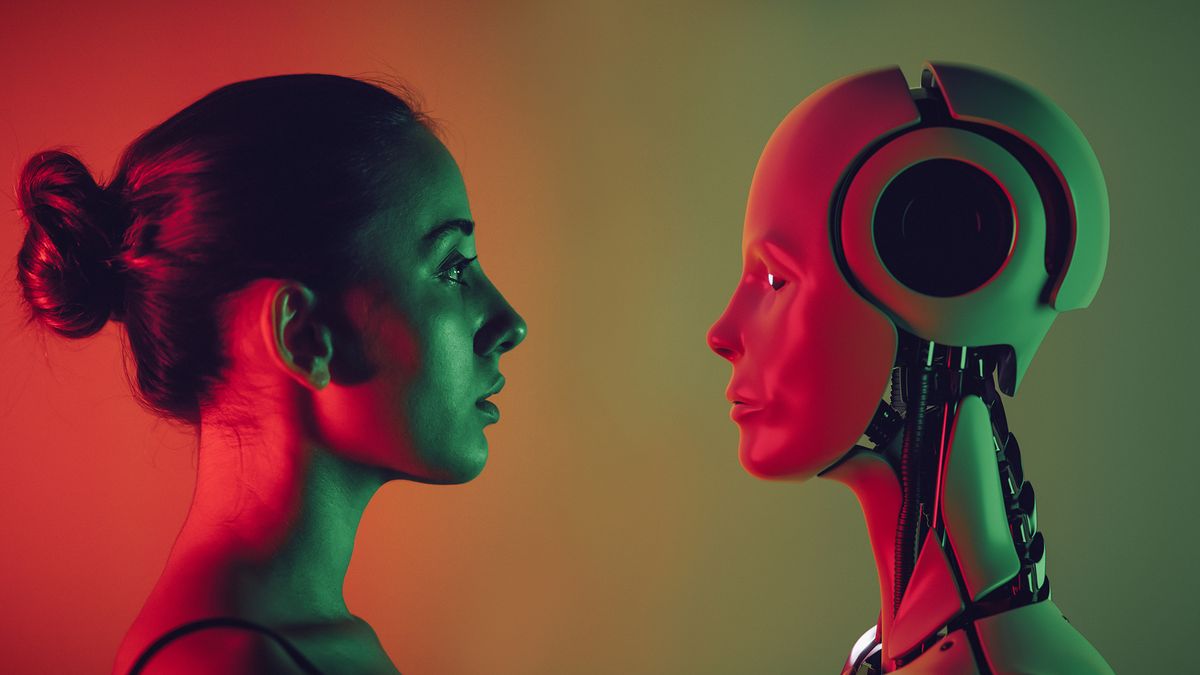

我们知道,人工智能(AI)无法以与人相同的方式思考,但是新的研究揭示了这种差异可能会影响AI的决策,从而导致现实的后果人可能没有做好准备。

该研究于2025年2月发表在《杂志》上机器学习研究的交易,检查了大型语言模型(LLM)如何形成类比。

他们发现,在简单的字母类似物和数字矩阵问题中,任务是通过识别丢失的数字来完成矩阵的任务 - 人类表现良好,但AI的性能急剧下降。

在测试人类和人工智能模型在基于故事的类比方面问题上的鲁棒性时,研究发现这些模型容易受到答案效应的影响 - 实验中由于治疗的顺序造成的响应差异 - 并且可能更有可能解释。

总的来说,研究得出的结论是,AI模型缺乏“零射”学习能力,其中学习者从培训期间不存在的课程中观察样本,并根据问题对他们所属于的班级做出预测。

有关的:

该研究的合着者玛莎·刘易斯,阿姆斯特丹大学神经肌委员会AI的助理教授举一个例子,说明了AI如何在字母弦问题中执行类似推理以及人类。

“字母字符串类比的形式是'如果ABCD去ABCE,IJKL去了什么?'刘易斯告诉《现场科学》,大多数人都会回答“ ijkm”,[AI]也倾向于给出这一回应。 “但是另一个问题可能是'如果ABBCD转到ABCD,IJKKL去了什么?

AI无法像人类一样重要的是为什么

刘易斯说,尽管我们可以从特定模式到更一般的规则抽象,但LLM并没有这种能力。 “他们擅长识别和匹配模式,但不从这些模式中概括。”

大多数AI应用程序在某种程度上都依赖于数量 - 可用的培训数据越多,确定的模式就越多。但是刘易斯强调了模式匹配和抽象不是同一回事。她补充说:“这与数据中的内容无关,而更多地与数据的使用方式有关。”

为了赋予这种影响,AI越来越多地用于法律领域,用于研究,判例法分析和量刑建议。但是,由于制作类比的能力较低,因此可能无法认识到法律先例在出现时如何适用于略有不同的情况。

鉴于这种缺乏鲁棒性可能会影响现实的结果,研究指出,这是我们需要仔细评估AI系统的证据,不仅是为了准确性,而且还要用于其认知能力的鲁棒性。