不到两周前,一家鲜为人知的中国公司发布了最新的(人工智能)模型并在世界范围内引起了冲击波。

DeepSeek 在一份上传至的技术论文中声称GitHub其开放式重量 R1 模型实现了可比较或更好的结果比一些领先的硅谷巨头制作的人工智能模型——即 OpenAI 的 ChatGPT、Meta 的 Llama 和 Anthropic 的 Claude。最令人惊讶的是,该模型以极低的成本进行训练和运行,却取得了这些结果。

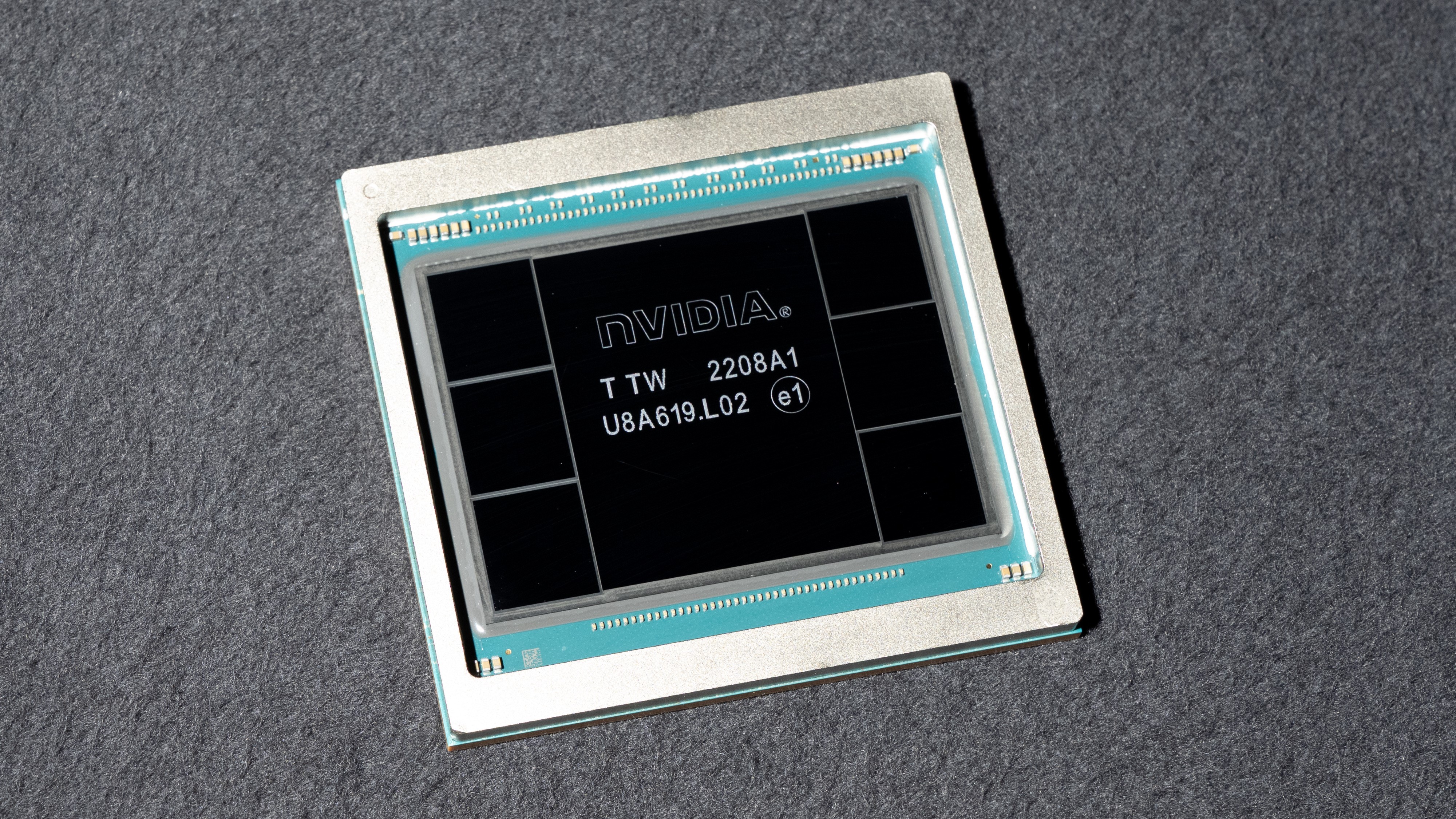

Nvidia 是一家生产被认为对 AI 训练至关重要的高端 H100 图形芯片的公司,该公司的估值损失了 5890 亿美元。美国历史上最大单日市场跌幅。毕竟,DeepSeek 表示,它在没有它们的情况下训练了人工智能模型——尽管它确实使用了性能较差的 Nvidia 芯片。美国科技公司的反应是恐慌和愤怒,OpenAI 代表甚至暗示 DeepSeek抄袭其模型的部分内容。

有关的:

人工智能专家表示,DeepSeek 的出现颠覆了支撑该行业增长方式的一个关键教条——表明越大并不总是越好。

“事实上,DeepSeek 可以用更少的钱、更少的计算和更少的时间构建,并且可以在更便宜的机器上本地运行,这一事实表明,随着每个人都竞相变得越来越大,我们错过了构建更智能、更小型的机会,”克里斯蒂安·哈蒙德,西北大学计算机科学教授在一封电子邮件中告诉《生活科学》。

但是什么让 DeepSeek 的 V3 和 R1 模型如此具有颠覆性呢?科学家说,关键是效率。

是什么让 DeepSeek 的模型发挥作用?

“在某些方面,DeepSeek 的进步更多的是进化性而非革命性,”安布吉·特瓦里密歇根大学统计和计算机科学教授告诉《生活科学》。 “他们仍然在非常大的模型(数百亿个参数)、非常大的数据集(数万亿个代币)和非常大的预算的主导范式下运行。”

Tewari 表示,如果我们从表面上看 DeepSeek 的说法,那么该公司方法的主要创新在于它如何利用其庞大而强大的模型来运行与其他系统一样好的运行,同时使用更少的资源。

其关键在于“专家混合”系统,该系统将 DeepSeek 的模型拆分为子模型,每个子模型专门处理特定的任务或数据类型。这伴随着一个承载系统,它不像其他模型那样应用整体惩罚来减慢负担过重的系统,而是动态地将任务从过度工作的子模型转移到工作不足的子模型。

“[这]意味着即使 V3 模型有 6710 亿个参数,但任何给定代币实际上只有 370 亿个参数被激活,”Tewari 说。令牌是指大语言模型(LLM)中的处理单元,相当于一块文本。

进一步实现这种负载平衡的是一种称为“推理时间计算扩展”的技术,这是 DeepSeek 模型中的一个旋钮,可以向上或向下调整分配的计算以匹配分配任务的复杂性。

这种效率延伸到了 DeepSeek 模型的训练,专家将此视为美国出口限制的意外后果。由于对 Nvidia 最先进的 H100 芯片的访问受到限制,因此 DeepSeek 声称它转而使用 H800 芯片构建模型,而 H800 芯片的芯片间数据传输速率较低。 Nvidia 在 2023 年专门设计了这款“较弱”的芯片,以规避出口管制。

一种更高效的大型语言模型

使用这些功能较弱的芯片的需求迫使 DeepSeek 做出另一项重大突破:其混合精度框架。它没有使用 32 位浮点数 (FP32) 来表示模型的所有权重(设置 AI 模型人工神经元之间连接强度的数字),而是使用不太精确的 8 位数字 (FP8) 来训练模型的一部分,在精度很重要的情况下仅切换到 32 位以进行更困难的计算。

“这可以用更少的计算资源进行更快的训练,”曹托马斯塔夫茨大学技术政策教授告诉《生活科学》。 “DeepSeek 还改进了其训练流程的几乎每一步——数据加载、并行化策略和内存优化——从而在实践中实现了非常高的效率。”

同样,虽然使用人类提供的标签来训练 AI 模型来对答案和推理的准确性进行评分是很常见的,但 R1 的推理是无监督的。它仅使用数学和编码等任务中最终答案的正确性作为其奖励信号,从而释放培训资源以在其他地方使用。

所有这些加起来构成了一对效率惊人的模型。虽然 DeepSeek 竞争对手的培训成本达到了数千万至数亿美元通常需要几个月的时间,DeepSeek 代表表示该公司在两个月内训练了 V3仅售 558 万美元。 DeepSeek V3 的运行成本同样很低 —21次运行起来比Anthropic 的克劳德 3.5 十四行诗。

曹谨慎地指出,DeepSeek 的研发,包括其硬件和大量的试错实验,意味着几乎可以肯定它的花费远远超过这个 558 万美元的数字。尽管如此,成本的大幅下降仍然足以让竞争对手措手不及。

总体而言,人工智能专家表示,DeepSeek 的流行可能对该行业产生积极的影响,降低过高的资源成本,并降低研究人员和公司的进入门槛。它还可以为比英伟达更多的芯片制造商创造参与竞争的空间。但它也有其自身的危险。

曹说:“随着开发尖端人工智能模型的更便宜、更有效的方法变得公开,它们可以让世界各地更多的研究人员追求尖端的法学硕士开发,从而有可能加速科学进步和应用程序创建。” “与此同时,这种较低的进入门槛带来了新的监管挑战——不仅仅是中美竞争——关于国家和非国家行为者滥用先进人工智能或潜在的不稳定影响。”