第二代 Meta 人工智能语言模型在第一代之后仅五个月就问世了。这是免费且开源的,但现在 Facebook 的母公司正在与微软合作开发它。谷歌和 LaMDA 最好要小心了。

与谷歌或 OpenAI 不同,Meta 团队还没有自己的通用公共对话工具,该工具由人工智能推动并为所有人所熟知。但自二月以来,他有会话语言。换句话说,正是这个引擎允许您开发从文本生成到动态生成的工具,包括更复杂的程序、数学分辨率、代码、科学研究工具等等。

LLaMA 2 刚刚在 7 月 18 日通过新闻稿宣布,它已经是第二代语言模型。与传闻相反金融时报最近几个小时,Meta 尚未对其模型进行付费访问,该模型甚至是开源的,可供研究人员和公司访问(用于商业目的)。“我们包括预训练模型和微调版本的模型权重和源代码”,我们可以阅读。理解通过“微调版本”,所有将使用该语言模型来实现特定用途和数据的程序。

就在大规模(特别是在法国)部署 LLaMA 2 一周后,宣布向全体 LLaMA 2 发布。Bard,谷歌的对话代理应该竞争聊天GPT。令人惊讶的效果是双重的:Meta 选择了开源模型,而 Google 和 OpenAI 则倾向于将其放在一边,而采用更保密的模型。“我认为如果生态系统更加开放,将会取得更多进展,这就是我们将 Llama 2 开源的原因””,马克·扎克伯格在 Facebook 上的一篇帖子中写道。第二个惊喜效应是微软作为该项目的特权合作伙伴的到来。因此,这家数字巨头同时与 OpenAI 和 Meta 合作,进一步孤立了谷歌。

微软,特权合作伙伴

Meta 似乎更专注于专业用途(ChatGPT 正在开发适合专业人士的版本)微软对此感到高兴,并联手成为“首选合作伙伴”。因此,LLaMA 并不是营销活动,而是对 Microsoft Azure 客户及其 AI 模型目录的新访问。同样地,“LLaMA 将进行优化,以便在 Windows 上本地运行。 Windows 开发人员将能够通过 ONNX 运行时定位 DirectML 运行时提供程序来使用 Llama »,微软在另一份新闻稿中指出。

两家公司已经合作发布了 PyTorch 框架,该框架自 2016 年以来一直是用于训练人工智能和深度学习神经网络的主要框架之一。然后,两人联手创建了 PyTorch 基金会,该基金会于 2022 年 9 月启动,目前负责管理该框架。继 Microsoft 之后,Amazon Web Services (AWS) 和 Hugging Face 的客户也将能够访问 LLaMA 2。

美洲驼 2 与 美洲驼 1

如果新闻稿没有真正关注 LLaMA 1 和 LLaMA 2 之间的差异,那么它与网站互联网的语言模型。由此我们得知,第二代训练的数据库比第一代大 40%。为了更好地理解、更好的预测和更适应的文本生成,Meta 告知 LLaMA 2 已将其« 上下文长度 »,上下文长度。它是决定结果性能的元素,但对于语言模型来说,它也是使运行变慢的元素。

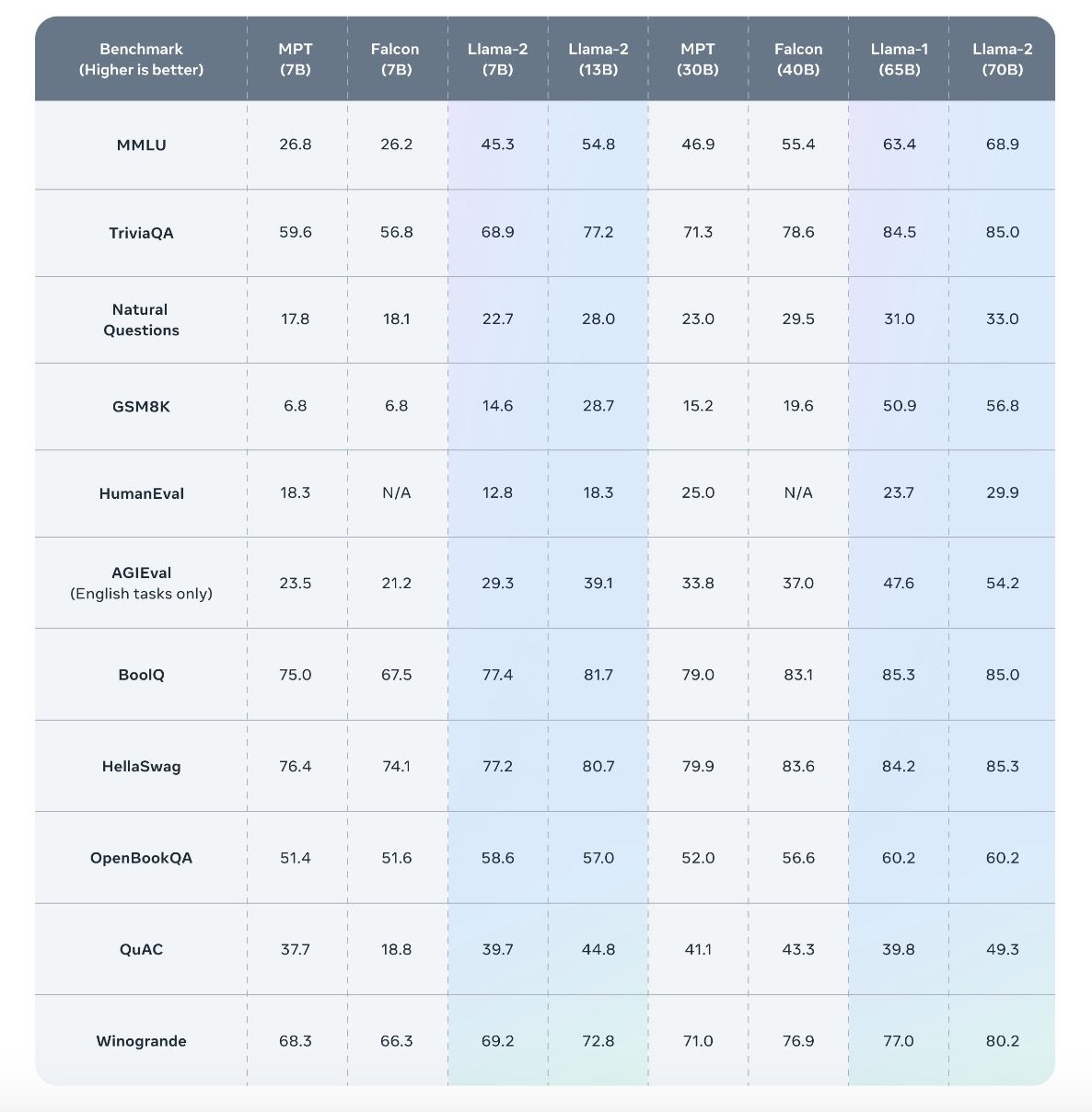

在速度方面,Meta 公布了其基准测试的多个结果,并将其与某些竞争对手(未引用 Google 和 OpenAI)以及 LLaMA 1 的不同版本的结果进行比较。图中,MPT 指的是开放的MosaicML 的源语言模型,以及阿布扎比技术创新研究所的开源语言模型 Falcon,该模型于去年 6 月发布,其性能尤其令人惊讶。根据 Meta 的说法,其 70B 参数下的最佳模型将优于 40B 参数下的 Falcon。

Meta 表示,从 2 月份至今,它已收到 100,000 个访问其 LLaMA 1 模型的请求,随着与微软的领先集成和关联,LLaMA 2 的使用可能会加强,除非像 Falcon 或来自谷歌和 OpenAI 的模型那样的竞争。超过。竞争将继续相同:提供更先进的模型,在“微调”版本中为特定用途提供更先进的模型,但也更轻,以便能够集成到更容易访问的机器中,包括学术界和商业界的机器。