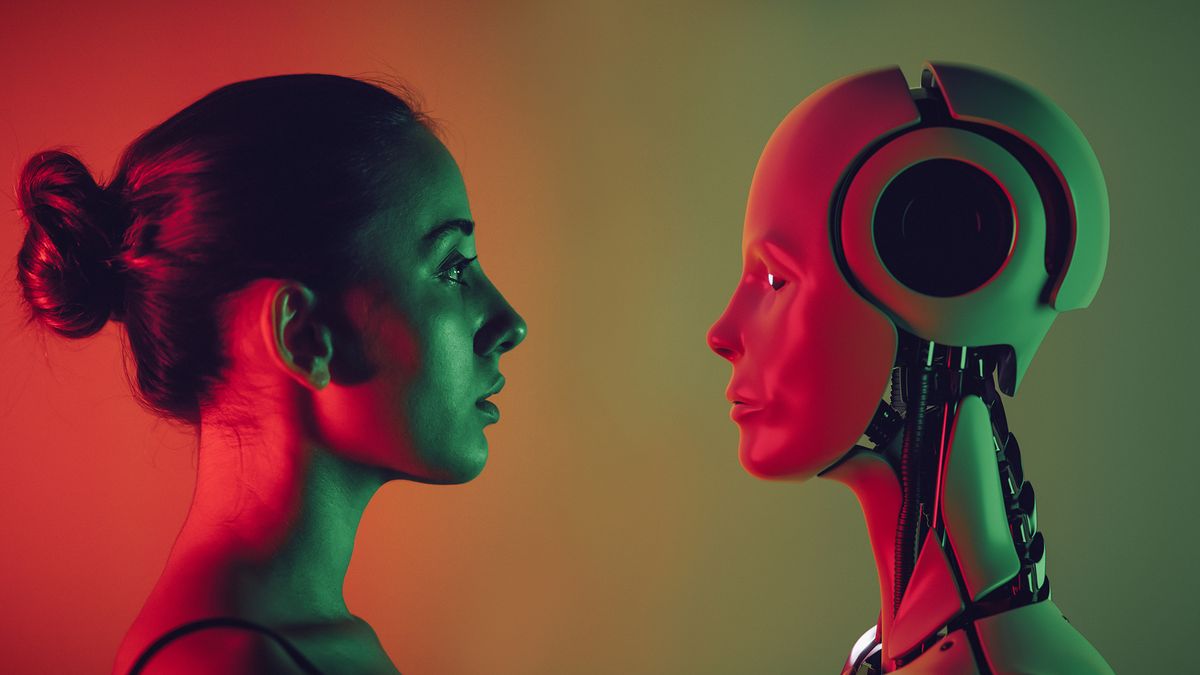

我們知道,人工智能(AI)無法以與人相同的方式思考,但是新的研究揭示了這種差異可能會影響AI的決策,從而導致現實的後果人可能沒有做好準備。

該研究於2025年2月發表在《雜誌》上機器學習研究的交易,檢查了大型語言模型(LLM)如何形成類比。

他們發現,在簡單的字母類似物和數字矩陣問題中,任務是通過識別丟失的數字來完成矩陣的任務 - 人類表現良好,但AI的性能急劇下降。

在測試人類和人工智能模型在基於故事的類比方面問題上的魯棒性時,研究發現這些模型容易受到答案效應的影響 - 實驗中由於治療的順序造成的響應差異 - 並且可能更有可能解釋。

總的來說,研究得出的結論是,AI模型缺乏“零射”學習能力,其中學習者從培訓期間不存在的課程中觀察樣本,並根據問題對他們所屬於的班級做出預測。

有關的:

該研究的合著者瑪莎·劉易斯,阿姆斯特丹大學神經肌委員會AI的助理教授舉一個例子,說明了AI如何在字母弦問題中執行類似推理以及人類。

“字母字符串類比的形式是'如果ABCD去ABCE,IJKL去了什麼?'劉易斯告訴《現場科學》,大多數人都會回答“ ijkm”,[AI]也傾向於給出這一回應。 “但是另一個問題可能是'如果ABBCD轉到ABCD,IJKKL去了什麼?

AI無法像人類一樣重要的是為什麼

劉易斯說,儘管我們可以從特定模式到更一般的規則抽象,但LLM並沒有這種能力。 “他們擅長識別和匹配模式,但不從這些模式中概括。”

大多數AI應用程序在某種程度上都依賴於數量 - 可用的培訓數據越多,確定的模式就越多。但是劉易斯強調了模式匹配和抽像不是同一回事。她補充說:“這與數據中的內容無關,而更多地與數據的使用方式有關。”

為了賦予這種影響,AI越來越多地用於法律領域,用於研究,判例法分析和量刑建議。但是,由於製作類比的能力較低,因此可能無法認識到法律先例在出現時如何適用於略有不同的情況。

鑑於這種缺乏魯棒性可能會影響現實的結果,研究指出,這是我們需要仔細評估AI系統的證據,不僅是為了準確性,而且還要用於其認知能力的魯棒性。