人工智能(AI)是指任何展現人類智能方面的技術,並且數十年來一直是計算機科學領域的重要領域。 AI任務可以包括從視覺場景中挑選對像到知道如何構架句子甚至預測股票價格變動的任何內容。

科學家一直在嘗試建立AI計算時代的曙光。這領先的方法在上個世紀的大部分時間裡,涉及創建大量的事實和規則數據庫,然後獲取基於邏輯的計算機程序來製定這些決定。但是本世紀已經發生了變化,新方法通過分析數據來吸引計算機來學習自己的事實和規則。這導致了該領域的重大進展。

在過去的十年中,機器在所有方面都表現出似乎“超人”的功能在醫學圖像中發現乳腺癌,玩惡魔般棘手的棋盤遊戲國際象棋- 甚至預測蛋白質的結構。

由於大型語言模型(LLM)Chatbot Chatgpt在2022年末爆發到現場,因此也有一個共識的日益增長我們可能會在復制更通用的智能的風口浪尖上,類似於人類的人工智能(AGI)。 AI公司Cohore創建的非營利性研究實驗室AI的負責人Sara Hooker說:“確實不能過分強調這對該領域的關鍵轉變。”

AI如何工作?

儘管科學家可以採用許多方法來構建AI系統,但機器學習是當今使用最廣泛的方法。這涉及將計算機分析數據識別然後可以用於做出預測的模式。

學習過程由演算法- 人類編寫的一系列指令,告訴計算機如何分析數據 - 該過程的輸出是編碼所有發現模式的統計模型。然後可以用新數據饋送來生成預測。

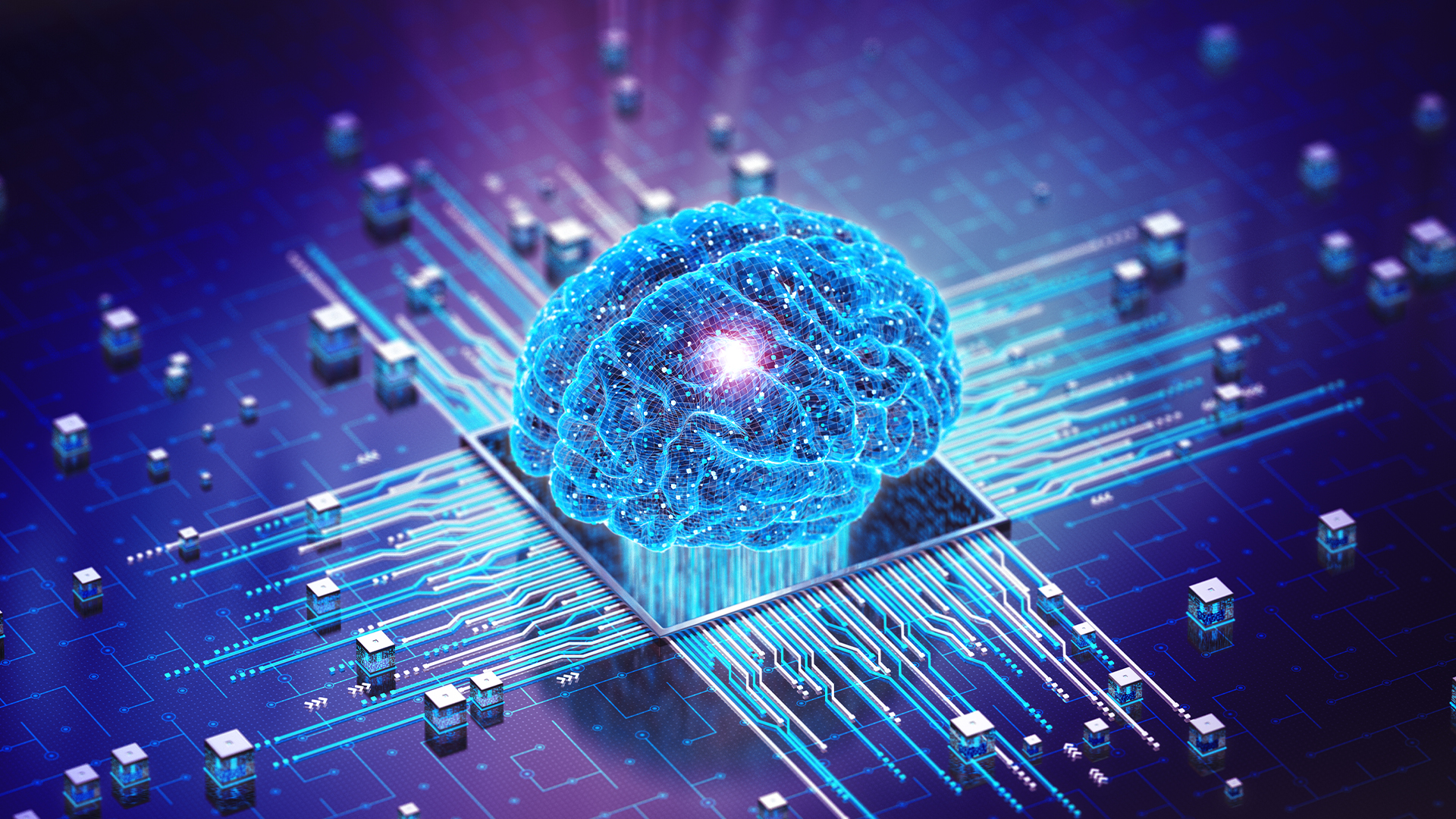

存在許多機器學習算法,但是神經網絡是當今使用最廣泛的。這些是機器學習算法的集合,該算法鬆散地模型人腦,他們通過調整“人造神經元”網絡之間的連接強度來學習。這是當今許多最受歡迎的AI服務(例如文本和圖像生成器)使用的架構。

當今大多數尖端的研究都涉及深度學習,它是指使用具有許多人造神經元的非常大的神經網絡。自1980年代以來,這個想法就已經存在 - 但是大量的數據和計算要求有限的應用程序。然後在2012年研究人員發現該專門的計算機芯片稱為圖形處理單元(GPU)加快了深度學習的速度。此後,深度學習一直是研究的黃金標準。

胡克說:“深度神經網絡是對類固醇的機器學習。” “它們都是計算最昂貴的模型,但通常也很大,強大且表現力”

但是,並非所有神經網絡都是相同的。不同的配置,或“架構”眾所周知,適合不同的任務。卷積神經網絡具有受動物視覺皮層啟發的連通性模式,並在視覺任務下出色。具有內部內存形式的複發性神經網絡專門研究順序數據。

算法也可以是受過不同的訓練取決於申請。最常見的方法稱為“監督學習”,涉及人類向每個數據分配標籤以指導模式學習過程。例如,您將標籤“貓”添加到貓的圖像中。

在“無監督的學習”中,培訓數據是未標記的,機器必須自行解決問題。這需要更多的數據,並且可能很難工作 - 但是,由於學習過程並沒有受到人類先入之見的限制,因此可以導致更豐富,更強大的模型。 LLMS最近的許多突破都使用了這種方法。

最後的主要培訓方法是“強化學習”,它使AI可以通過反複試驗學習。這最常用於訓練遊戲玩遊戲系統或機器人 - 包括類人類機器人圖01,或這些足球播放的微型機器人- 並反复嘗試執行任務並更新一組內部規則,以響應正面或負面的反饋。這種方法為Google提供動力深態開創性的Alphago模型。

什麼是生成AI?

儘管在過去的十年中深入學習取得了一系列的一系列成功,但很少有人以與Chatgpt無情的人類對話能力相同的方式吸引了公眾的想像力。這是使用深度學習和神經網絡來基於用戶的輸入(包括)生成輸出的幾種生成AI系統之一,包括文字,,,,圖像,,,,聲音的甚至影片。

諸如chatgpt之類的文本生成器使用AI的子集運行“自然語言處理”(NLP)。這一突破的起源可以追溯到Google科學家介紹的新穎的深度學習建築2017年稱為“變壓器”。

變壓器算法專門針對大量的順序數據收集(尤其是書面文本的大部分)進行無監督的學習。他們擅長這樣做,因為他們可以比以前的方法更好地跟踪遙遠數據點之間的關係,這使他們能夠更好地了解自己所看的內容的背景。

胡克說:“我接下來的話取決於我之前所說的話 - 我們的語言及時連接。” “這是關鍵的突破之一,這種能力實際上是整個單詞。”

LLMS學習通過在句子中掩蓋下一個單詞,然後試圖根據以前的情況猜測它是什麼。培訓數據已經包含答案,因此該方法不需要任何人類的標籤,因此可以簡單地從Internet刮擦數據並將其輸入算法。變形金剛還可以並行執行此培訓遊戲的多個實例,這使他們可以更快地通過數據流動。

通過對如此大量數據的培訓,變形金剛可以生成非常複雜的人類語言模型,因此可以成為“大語言模型”綽號。他們還可以分析和生成與人類可以生成的文本非常相似的複雜,長格式的文本。變形金剛徹底改變了不僅是語言。同一體系結構也可以並行對文本和圖像數據進行訓練,從而產生諸如穩定擴散和dall-e之類的模型,這些模型從簡單的書面描述中產生了高定義的圖像。

變形金剛在Google Deepmind的Alphafold 2模型可以從氨基酸序列產生蛋白質結構。這種產生原始數據的能力,而不是簡單地分析現有數據的原因是這些模型被稱為“生成AI”的原因。

狹窄的AI與人工通用智能(AGI):有什麼區別?

由於他們可以執行的任務廣度,人們對LLM感到興奮。大多數機器學習系統都經過培訓以解決特定問題,例如在視頻供稿中檢測面孔或從一種語言轉換為另一種語言。這些模型被稱為“狹窄的AI”,因為它們只能處理訓練的特定任務。

大多數機器學習系統都經過解決特定問題的培訓,例如在視頻供稿中檢測面孔或從一種語言轉換為另一種語言,轉換為超人級別,因為它們比人類更快並且表現更好。但是像chatgpt這樣的LLMS代表了AI功能中的逐步變化,因為單個模型可以執行各種任務。他們可以回答有關各種主題的問題,總結文檔,在語言之間翻譯和寫代碼。

這種概括他們學到的解決許多不同問題的能力導致一些人推測LLM可能是邁向AGI的一步,其中包括去年發表的論文中的Deepmind科學家。 AGI指的是假設的未來AI能夠掌握人類所能掌握的任何認知任務,抽像地對問題進行推理,並在沒有特定培訓的情況下適應新情況。

AI愛好者預測,一旦實現了AGI,技術進步將迅速加速 - 一個被稱為“奇異性”的拐點,然後將實現突破。也有感知的存在風險從大規模的經濟和勞動力市場中斷到AI發現新病原體或武器的潛力。

但是,關於LLM是否將是AGI的先驅,還是僅僅是一個建築,仍然存在爭議。AI體系結構的更廣泛的網絡或生態系統AGI需要那。有人說LLM距離複製幾英里遠人類推理和認知能力。根據批評者的說法,這些模型簡單記住大量信息,他們以給出更深層理解的錯誤印象的方式重組;這意味著它們受培訓數據的限制,並且與其他狹窄的AI工具沒有根本不同。

Hooker說,儘管如此,某些LLM代表了科學家如何處理AI發展的地震轉變。尖端研究現在沒有針對特定任務進行培訓模型,而是採用這些預訓練的,功能良好的模型,並將其適應特定的用例。這導致他們被稱為“基礎模型”。

Hooker補充說:“人們正在從只能做一件事情的非常專業的模型轉變為基礎模型,該模型可以做到一切。” “它們是建造一切的模型。”

AI在現實世界中如何使用?

機器學習等技術無處不在。 AI驅動的推薦算法決定您在Netflix或YouTube上觀看的內容,而翻譯模型則可以立即將網頁從外語轉換為您自己的內容。您的銀行可能還使用AI模型來檢測您帳戶上可能暗示欺詐的任何異常活動,並且監視攝像機和自動駕駛汽車使用計算機視覺模型從視頻提要中識別人員和對象。

但是,生成的AI工具和服務開始逐漸進入現實世界,而不是像Chatgpt這樣的新穎聊天機器人。現在,大多數主要的AI開發人員都有一個聊天機器人,可以回答用戶在各種主題,分析和匯總文檔並在語言之間翻譯的問題。這些模型也已集成到搜索引擎中 - 雙子座進入Google搜索 - 公司還正在建立AI驅動的數字助理,以幫助程序員編寫代碼,例如github副標士。對於使用文字處理器或電子郵件客戶的人來說,它們甚至可以成為提高生產力的工具。

聊天機器人風格的AI工具是最常見的生成AI服務,但是儘管具有令人印象深刻的性能,但LLMS仍然遠非完美。他們對哪些單詞應遵循特定提示進行統計猜測。儘管它們經常產生表明理解的結果,但他們也可以自信地產生合理但錯誤的答案 - 稱為“稱為”幻覺。 ”

雖然生成的AI變得越來越普遍,但尚不清楚這些工具將在何處或如何最有用。胡克說,鑑於技術的新鮮感,有理由謹慎對其推出的速度持謹慎態度。她補充說:“在技術可能性的前沿,但同時進行了廣泛部署,這是非常不尋常的。” “這帶來了自身的風險和挑戰。”