雖然有「馬口中出」的說法,但馬不可能告訴你它是在痛苦還是在享受快樂。 然而,它的身體會用它的動作來表達答案。 對於訓練有素的眼睛來說,疼痛會表現為步態的變化,而在快樂的情況下,動物的面部表情可能會改變。 但如果我們可以透過人工智慧實現自動化呢? 那麼牛、狗、貓甚至老鼠的人工智慧模型又如何呢?

動物行為自動化不僅消除了觀察者的偏見,而且可以幫助人類更有效地獲得正確的答案。

一項新研究標誌著行為表型姿勢分析新篇章的開始。 Mackenzie Mathis 位於 EPFL 的實驗室發表A自然通訊文章描述了一種特別有效的新開源工具,無需人工註釋即可讓模型追蹤動物。

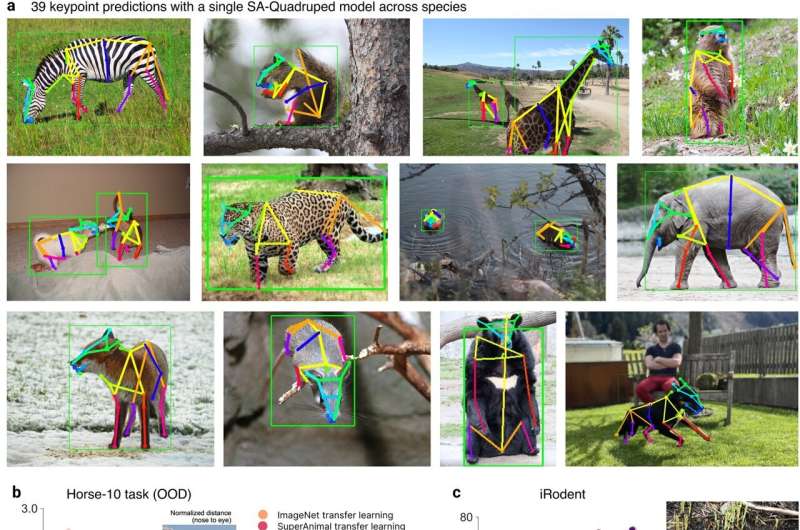

它被命名為“SuperAnimal”,無需人工監督即可自動識別各種動物(超過 45 種)的“關鍵點”(通常是關節)的位置。——甚至在神話中也是如此。

「目前的管道允許用戶自訂,但這依賴於人類努力識別每隻動物的關鍵點來創建訓練集,」馬蒂斯解釋道。

「這導致研究人員重複標記工作,並可能導致相同關鍵點的不同語義標籤,使得合併資料來訓練大型基礎模型非常具有挑戰性。我們的新方法提供了一種標準化此過程和訓練大型資料集的新方法。

「SuperAnimal 方法」是馬西斯實驗室已經以「DeepLabCut️」名稱發布的姿勢估計技術的演變。

「在這裡,我們開發了一種演算法,能夠跨資料庫編譯大量註釋並訓練模型以學習統一的語言 - 我們稱之為預訓練基礎模型,」博士 Shaokai Ye 解釋道。 學生研究員和該研究的第一作者。 “然後用戶可以簡單地部署我們的基本模型或根據自己的數據對其進行微調,從而在需要時進行進一步的自訂。”

這些進步將使運動分析變得更加容易。 「獸醫以及那些在——尤其是在觀察實驗室小鼠的行為時。 但它可以走得更遠。內。

「我們還將在自然語言介面中利用這些模型來建立更易於存取的下一代工具。例如,我和 Shaokai 以及我們在 EPFL 的合著者最近開發了 AmadeusGPT,最近發表在神經資訊處理系統,允許使用書面或口頭文字查詢視訊資料。

“將其擴展到複雜的行為分析將非常令人興奮。”

SuperAnimal 現在可以透過其開源發行版向全世界的研究人員開放(github.com/DeepLabCut)。